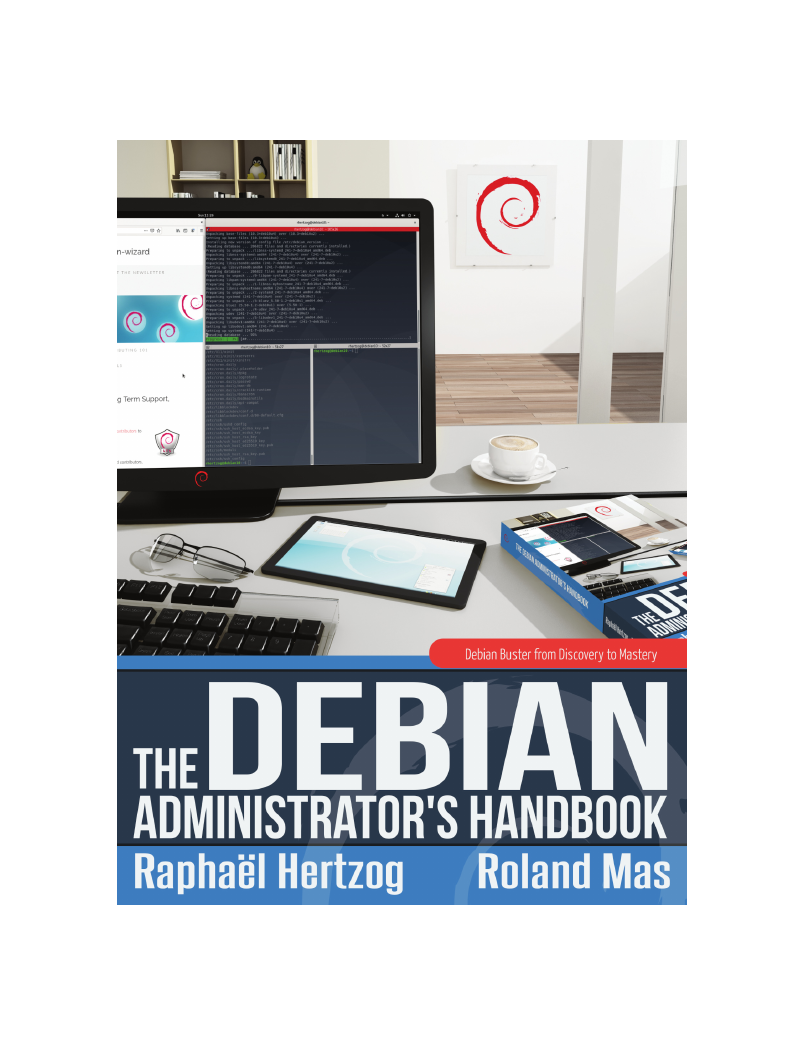

The Debian Administrator’s Handbook

Debian Buster from Discovery to Mastery

Raphaël Hertzog and Roland Mas

Freexian SARL

Sorbiers

The Debian Administrator’s Handbook

Raphaël Hertzog and Roland Mas

Copyright © 2003-2020 Raphaël Hertzog

Copyright © 2006-2015 Roland Mas

Copyright © 2012-2020 Freexian SARL

ISBN: 979-10-91414-19-7 (English paperback)

ISBN: 979-10-91414-20-3 (English ebook)

This book is available under the terms of two licenses compatible with the Debian Free Software Guide-

lines.

Creative Commons License Notice: This book is licensed under a Creative Commons Attribution-

ShareAlike 3.0 Unported License.

è https://creativecommons.org/licenses/by-sa/3.0/

GNU General Public License Notice: This book is free documentation: you can redistribute it and/or

modify it under the terms of the GNU General Public License as published by the Free Software Founda-

tion, either version 2 of the License, or (at your option) any later version.

This book is distributed in the hope that it will be useful, but WITHOUT ANY WARRANTY; without even

the implied warranty of MERCHANTABILITY or FITNESS FOR A PARTICULAR PURPOSE. See the GNU Gen-

eral Public License for more details.

You should have received a copy of the GNU General Public License along with this program. If not, see

Show your appreciation

This book is published under a free license because we want everybody to ben-

efit from it. That said maintaining it takes time and lots of effort, and we ap-

preciate being thanked for this. If you find this book valuable, please consider

contributing to its continued maintenance either by buying a paperback copy or

by making a donation through the book’s official website:

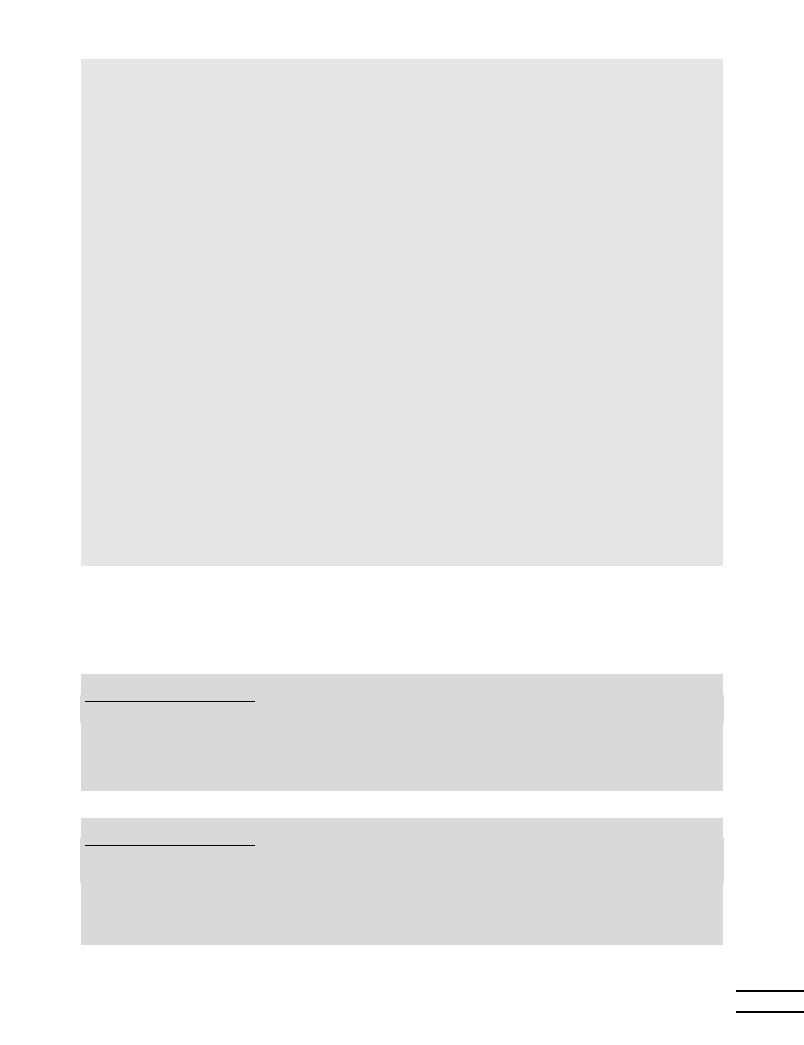

Table of Contents

1. The Debian Project

1.1 What Is Debian?

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

1.1.1 A Multi-Platform Operating System

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

1.1.2 The Quality of Free Software

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

1.1.3 The Legal Framework: A Non-Profit Organization

. . . . . . . . . . . . . . . . . . . . . . . . . . . .

1.2 The Foundation Documents

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

1.2.1 The Commitment towards Users

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

1.2.2 The Debian Free Software Guidelines

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

1.3 The Inner Workings of the Debian Project

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

1.3.1 The Debian Developers

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

1.3.2 The Active Role of Users

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 13

Reporting bugs

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 14

Translation and documentation

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 15

Sending fixes

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 15

Other ways of contributing

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 17

1.3.3 Teams and Sub-Projects

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 17

Existing Debian Sub-Projects

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 18

Administrative Teams

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 19

Development Teams, Transversal Teams

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 20

1.4 Follow Debian News

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 21

1.5 The Role of Distributions

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 23

1.5.1 The Installer: debian-installer

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 23

1.5.2 The Software Library

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 23

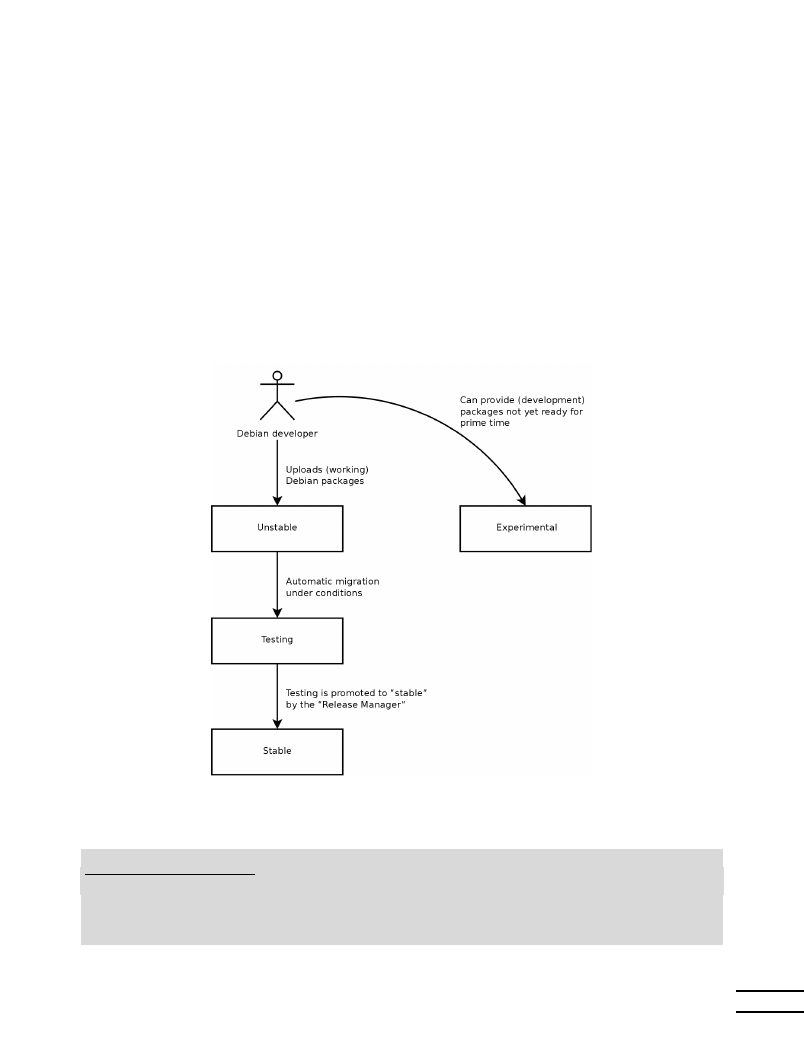

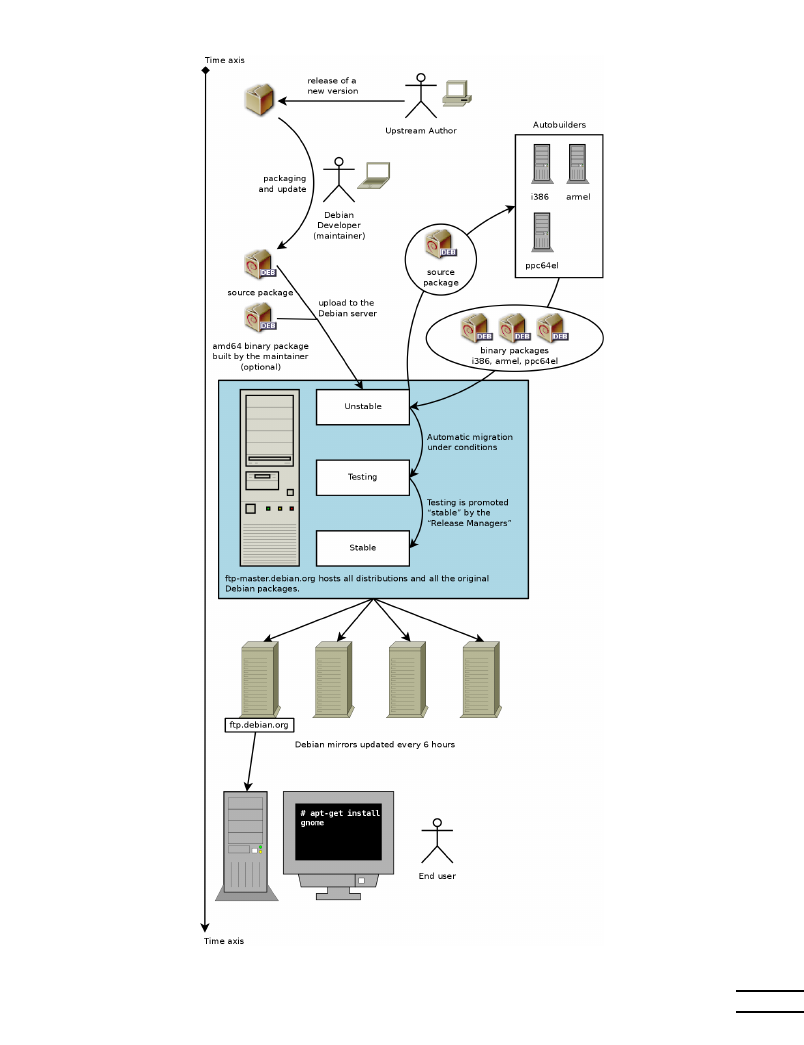

1.6 Lifecycle of a Release

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 24

1.6.1 The

Experimental Status

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 24

1.6.2 The

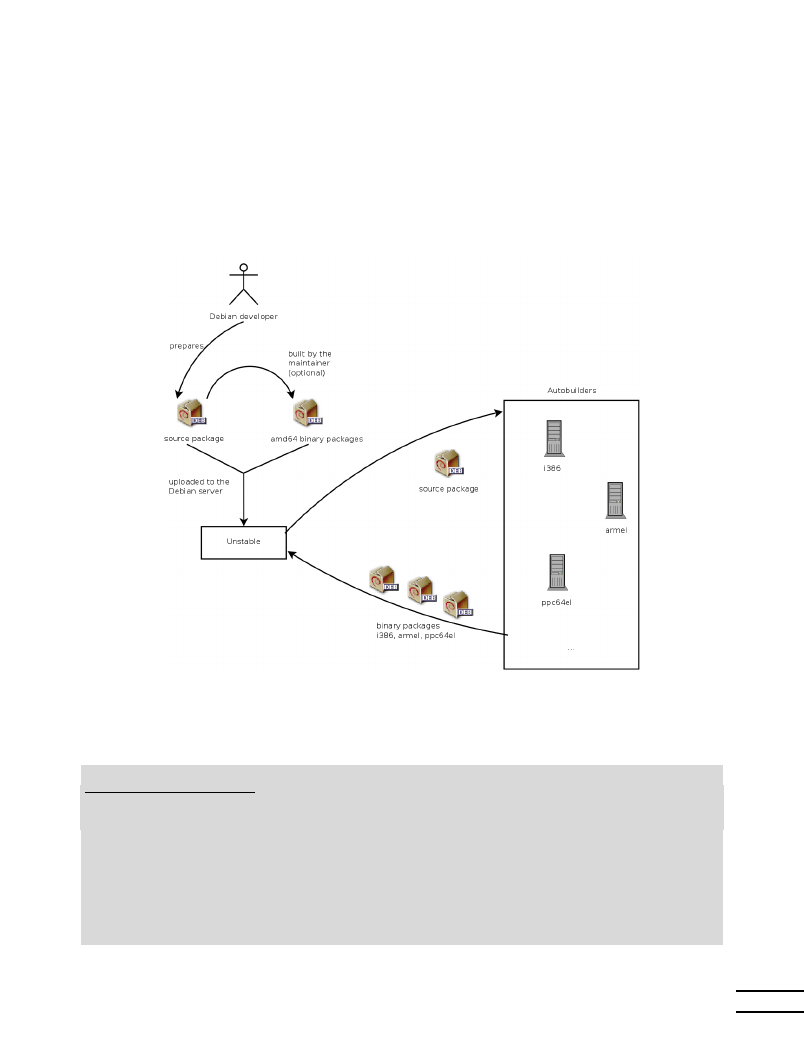

Unstable Status

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 24

1.6.3 Migration to

Testing

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 26

1.6.4 The Promotion from

Testing to Stable

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 27

1.6.5 The

Oldstable and Oldoldstable Status

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 30

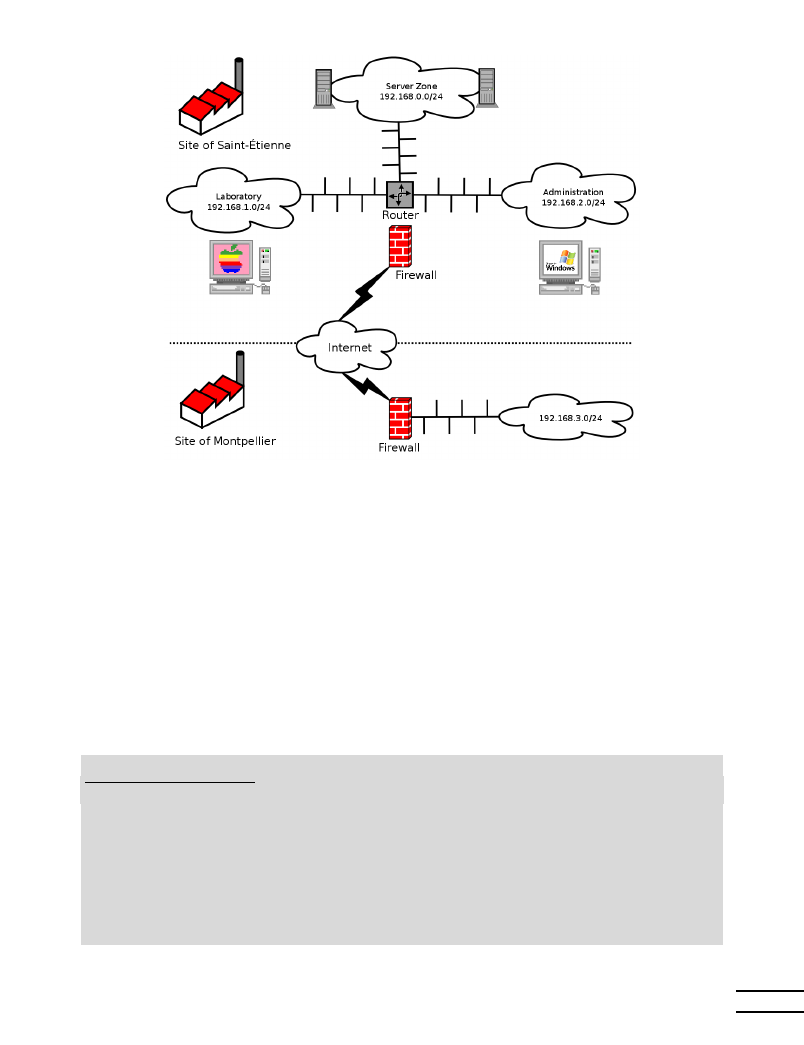

2. Presenting the Case Study

2.1 Fast Growing IT Needs

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 34

2.2 Master Plan

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 34

2.3 Why a GNU/Linux Distribution?

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 35

2.4 Why the Debian Distribution?

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 37

2.4.1 Commercial and Community Driven Distributions

. . . . . . . . . . . . . . . . . . . . . . . . . . . 37

2.5 Why Debian Buster?

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 38

3. Analyzing the Existing Setup and Migrating

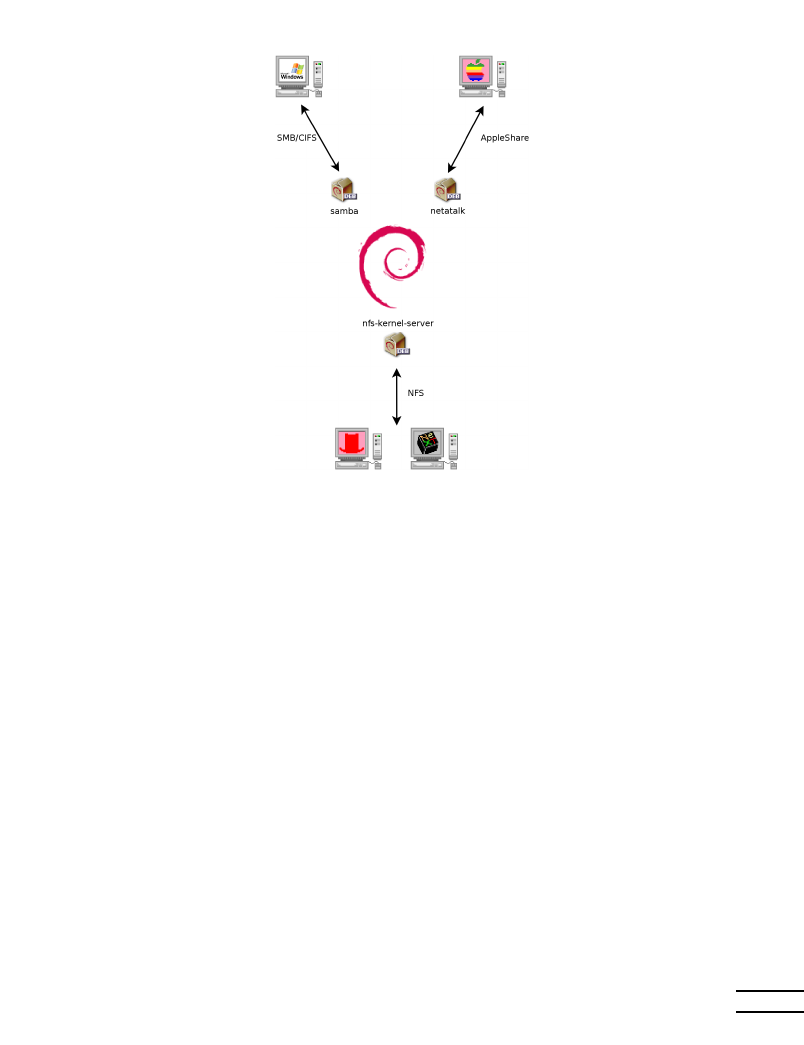

3.1 Coexistence in Heterogeneous Environments

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . 42

3.1.1 Integration with Windows Machines

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 42

3.1.2 Integration with OS X machines

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 42

3.1.3 Integration with Other Linux/Unix Machines

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 42

3.2 How To Migrate

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 43

3.2.1 Survey and Identify Services

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 43

Network and Processes

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 44

3.2.2 Backing up the Configuration

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 45

3.2.3 Taking Over an Existing Debian Server

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 45

3.2.4 Installing Debian

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 46

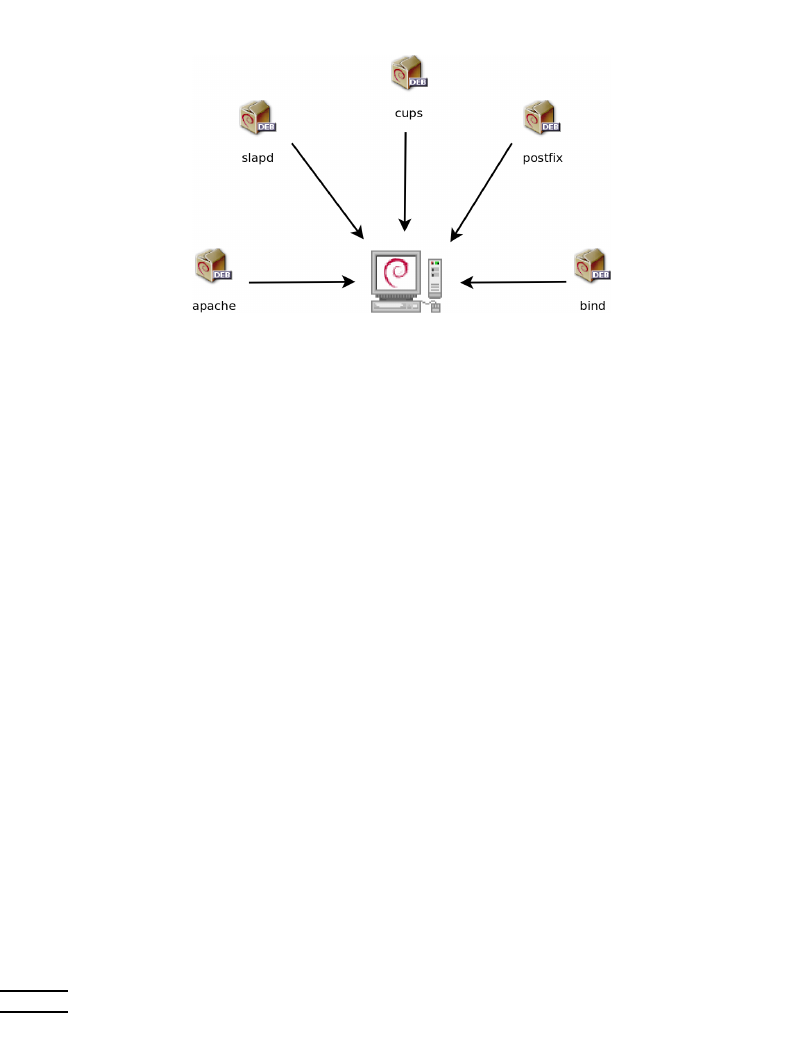

3.2.5 Installing and Configuring the Selected Services

. . . . . . . . . . . . . . . . . . . . . . . . . . . . 47

4. Installation

4.1 Installation Methods

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 52

4.1.1 Installing from a CD-ROM/DVD-ROM

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 52

4.1.2 Booting from a USB Key

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 53

4.1.3 Installing through Network Booting

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 54

4.1.4 Other Installation Methods

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 54

4.2 Installing, Step by Step

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 54

4.2.1 Booting and Starting the Installer

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 54

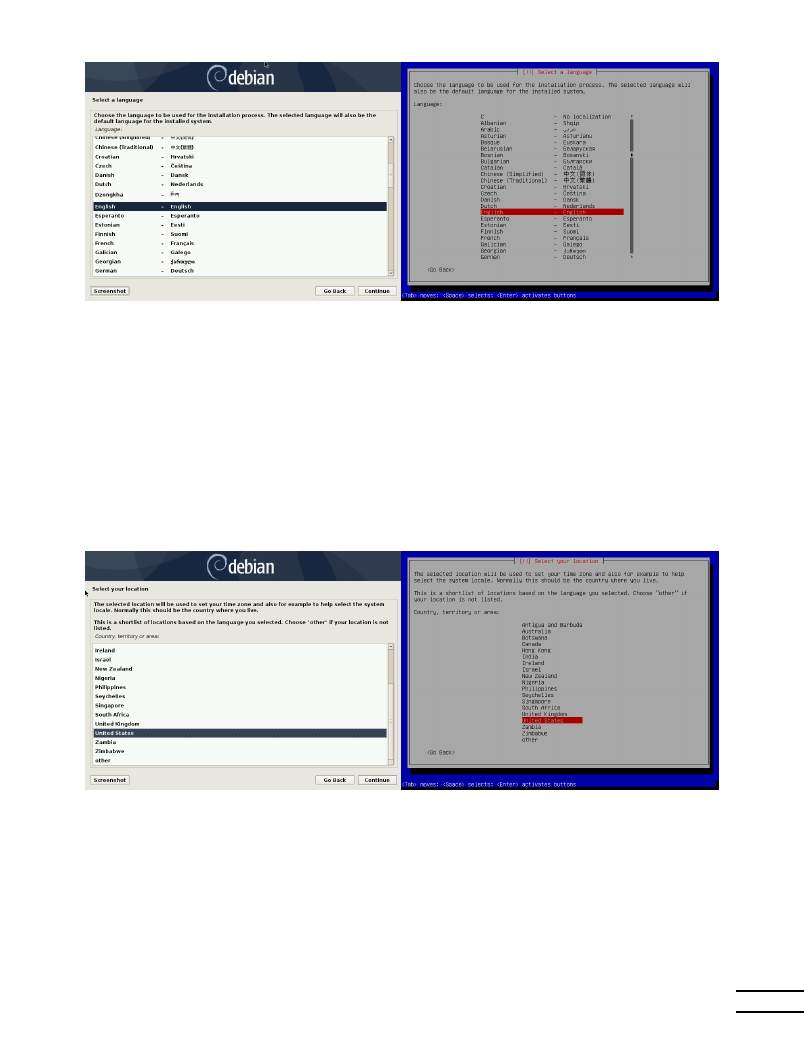

4.2.2 Selecting the language

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 56

4.2.3 Selecting the country

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 57

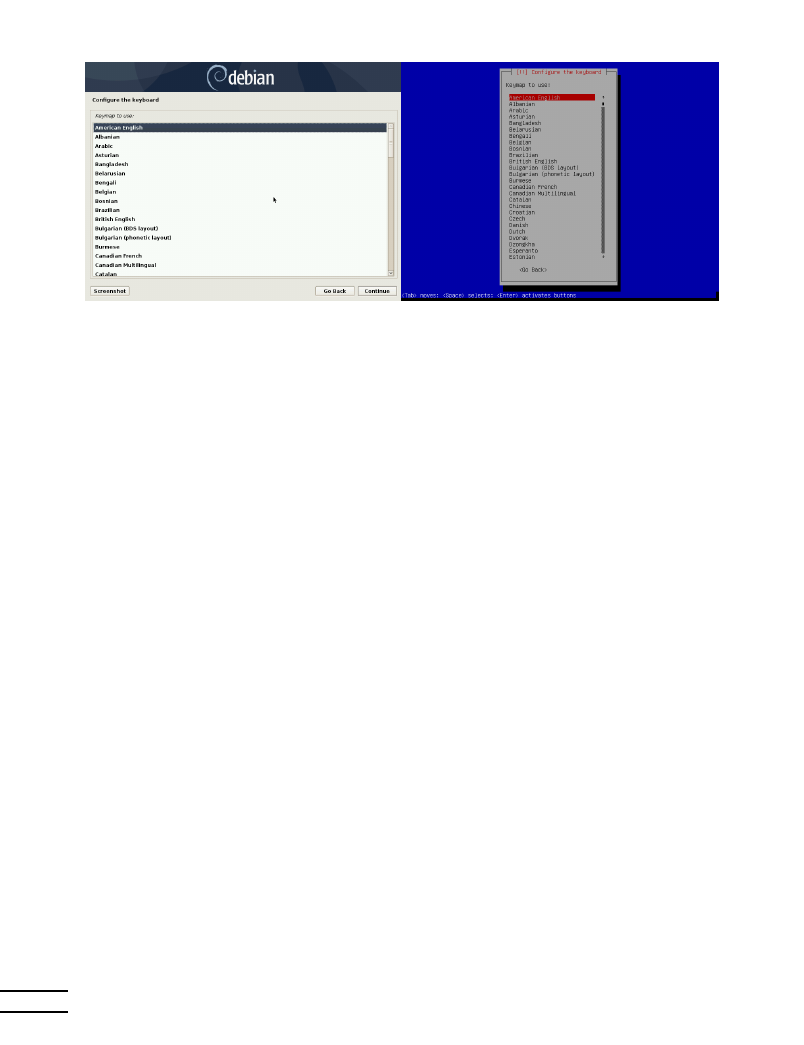

4.2.4 Selecting the keyboard layout

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 57

4.2.5 Detecting Hardware

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 58

4.2.6 Loading Components

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 58

4.2.7 Detecting Network Hardware

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 58

4.2.8 Configuring the Network

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 59

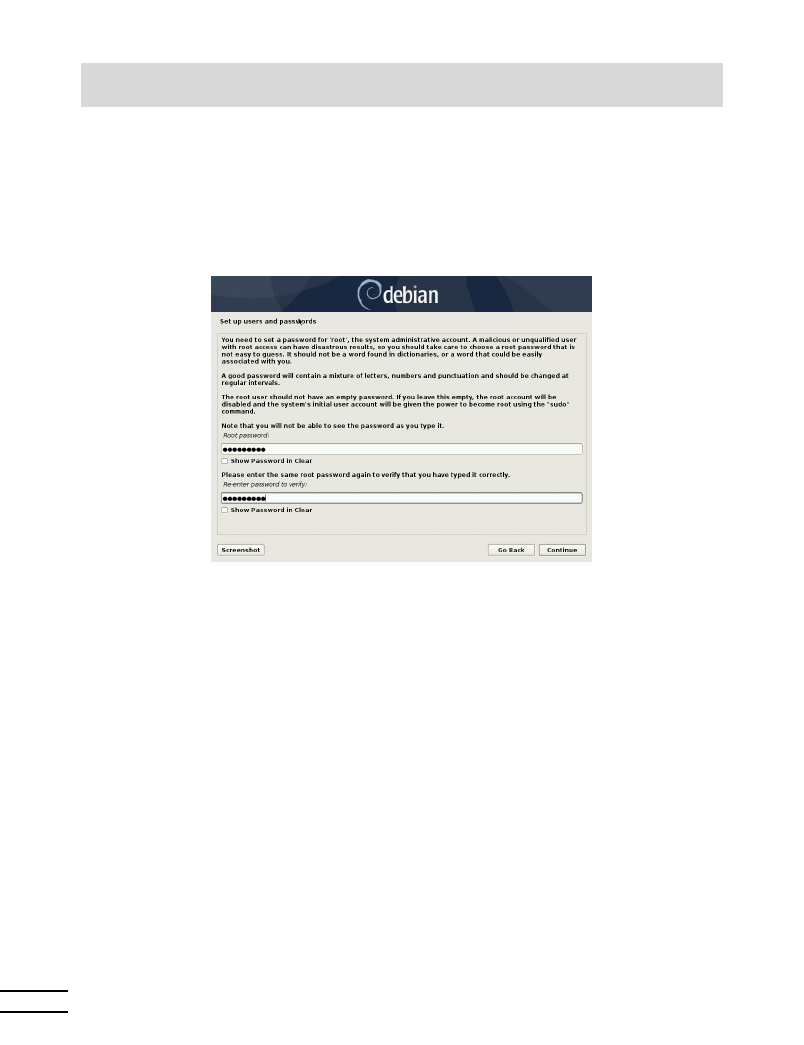

4.2.9 Administrator Password

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 59

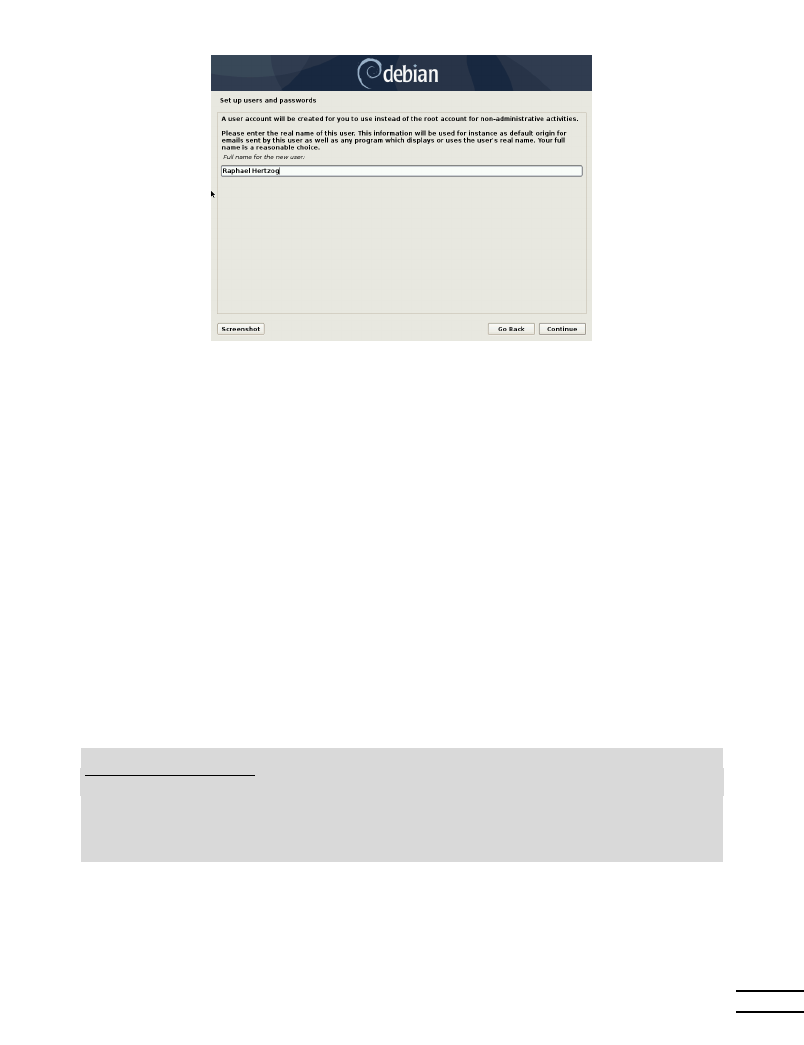

4.2.10 Creating the First User

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 60

4.2.11 Configuring the Clock

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 61

4.2.12 Detecting Disks and Other Devices

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 61

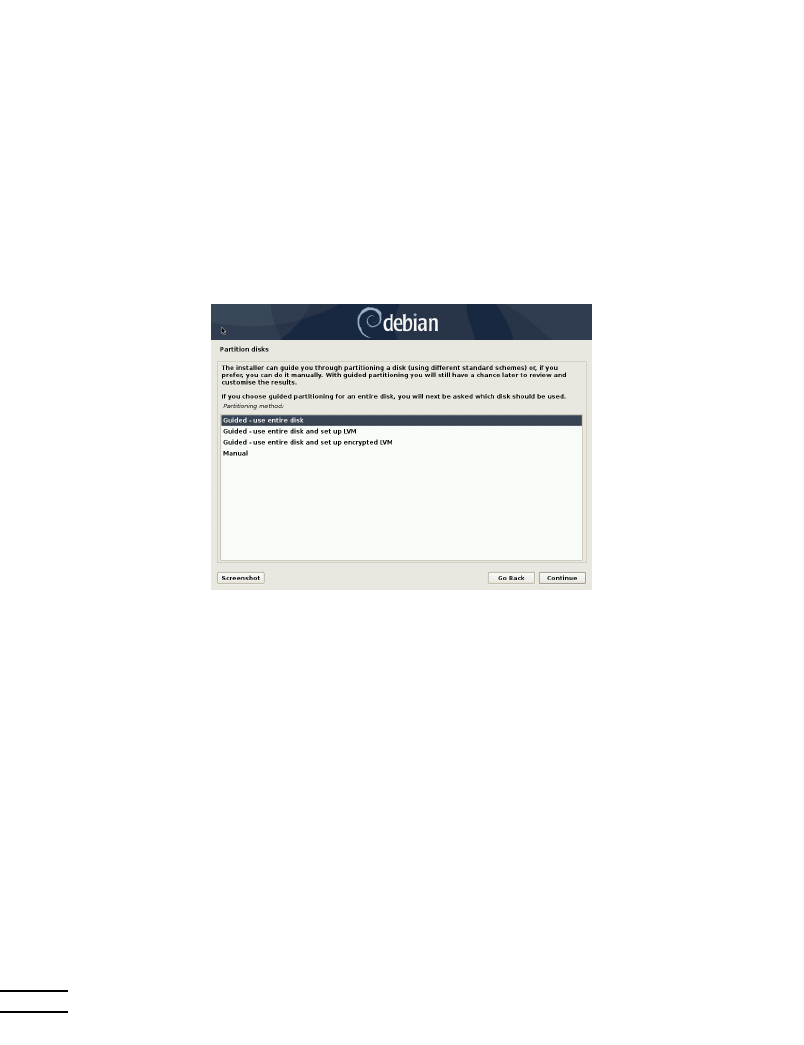

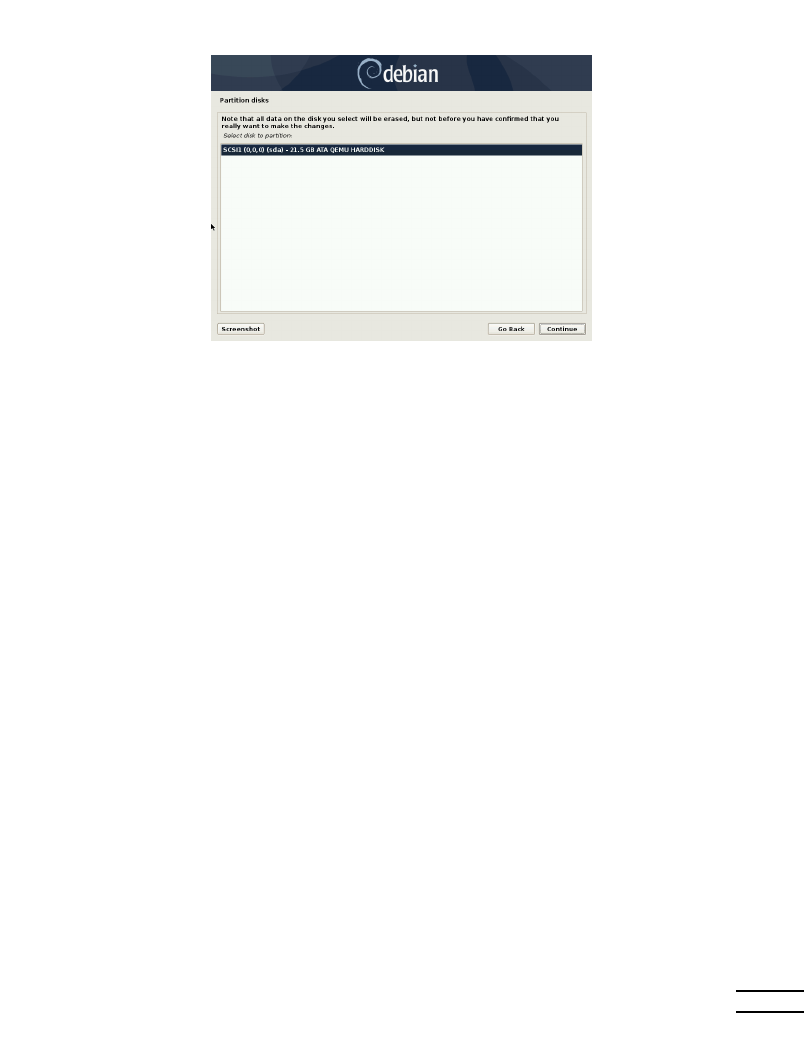

4.2.13 Starting the Partitioning Tool

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 61

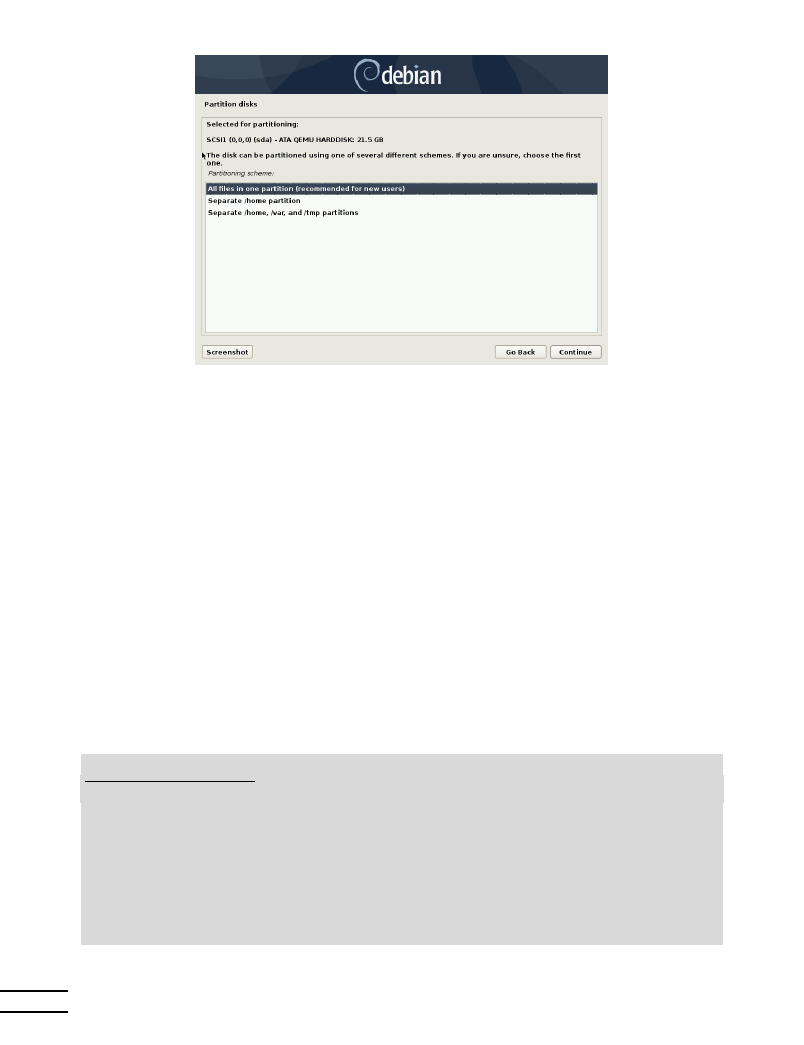

Guided partitioning

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 63

Manual Partitioning

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 65

Configuring Multidisk Devices (Software RAID)

. . . . . . . . . . . . . . . . . . . . . . . . . . . . 67

Configuring the Logical Volume Manager (LVM)

. . . . . . . . . . . . . . . . . . . . . . . . . . . . 67

Setting Up Encrypted Partitions

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 68

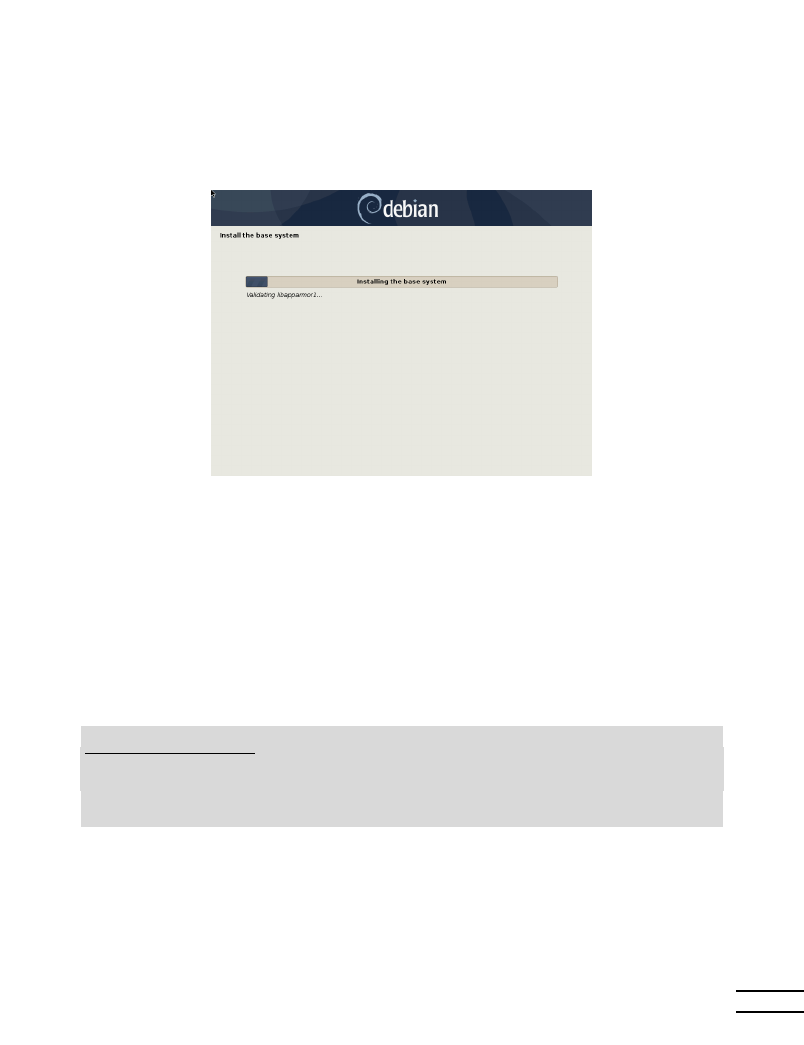

4.2.14 Installing the Base System

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 69

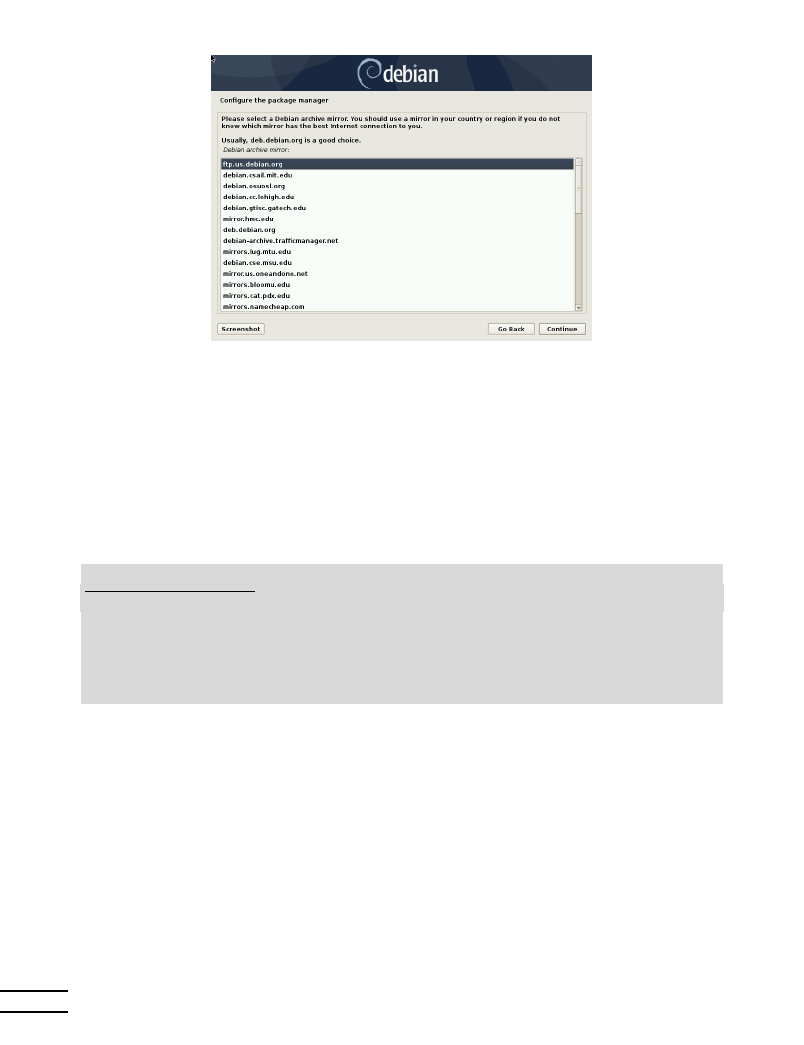

4.2.15 Configuring the Package Manager (apt)

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 69

4.2.16 Debian Package Popularity Contest

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 70

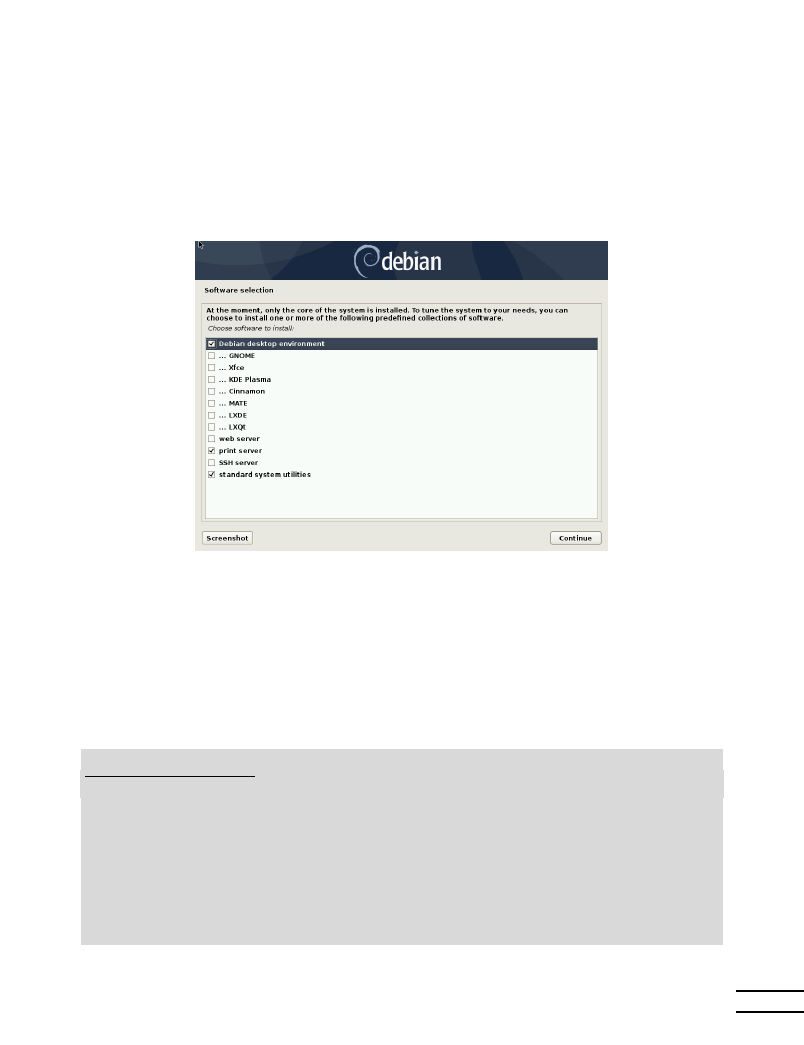

4.2.17 Selecting Packages for Installation

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 71

IV

The Debian Administrator’s Handbook

4.2.18 Installing the GRUB Bootloader

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 71

4.2.19 Finishing the Installation and Rebooting

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 72

4.3 After the First Boot

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 73

4.3.1 Installing Additional Software

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 73

4.3.2 Upgrading the System

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 74

5. Packaging System: Tools and Fundamental Principles

5.1 Structure of a Binary Package

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 78

5.2 Package Meta-Information

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 80

5.2.1 Description: the control File

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 80

Dependencies: the Depends Field

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 81

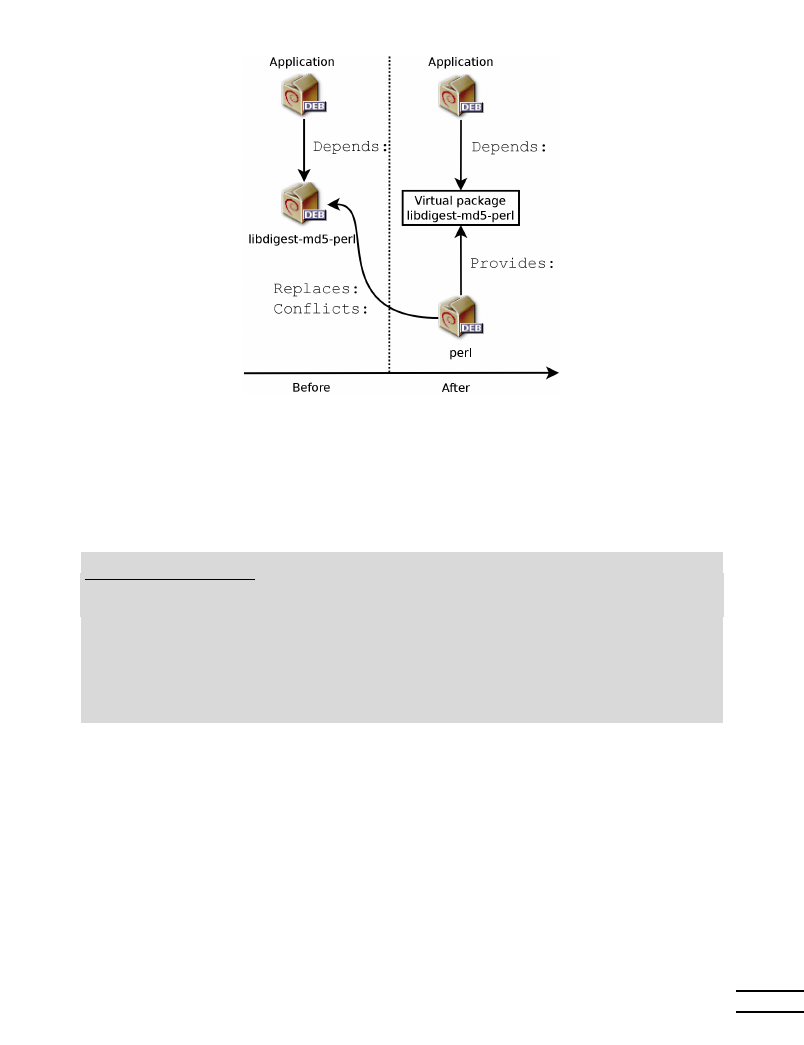

Conflicts: the Conflicts field

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 83

Incompatibilities: the Breaks Field

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 83

Provided Items: the Provides Field

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 83

Replacing Files: The Replaces Field

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 86

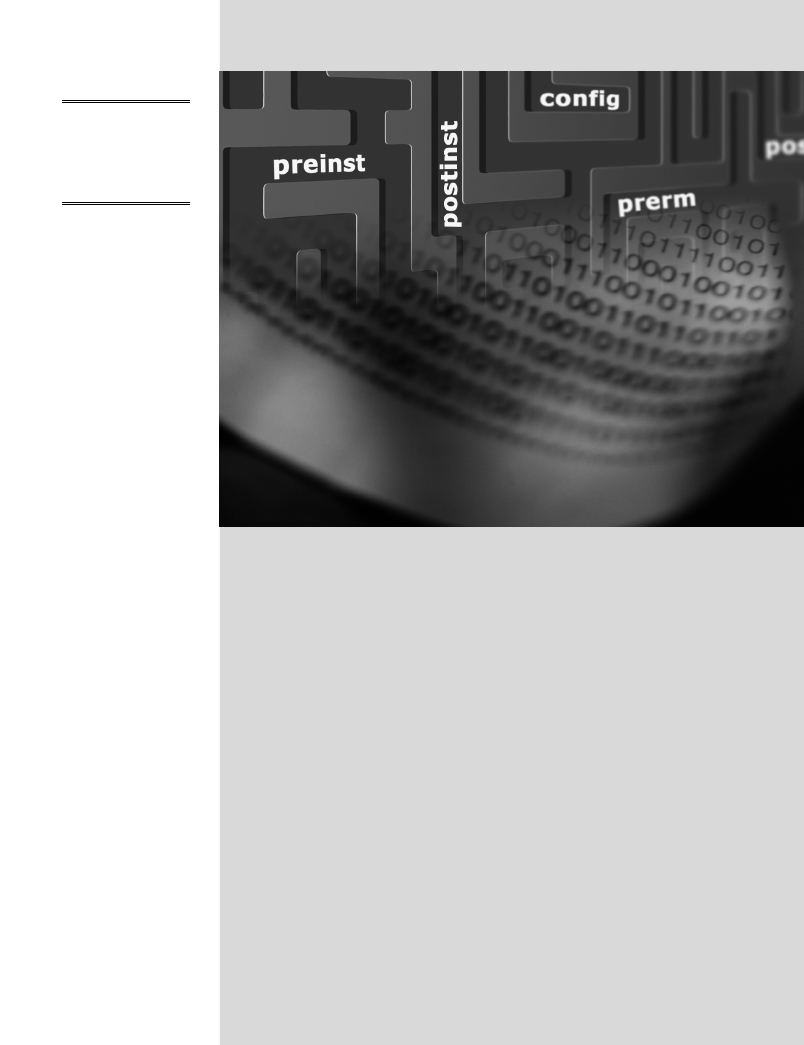

5.2.2 Configuration Scripts

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 86

Installation and Upgrade

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 87

Package Removal

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 87

5.2.3 Checksums, List of Configuration Files

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 89

5.3 Structure of a Source Package

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 90

5.3.1 Format

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 90

5.3.2 Usage within Debian

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 93

5.4 Manipulating Packages with dpkg

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 94

5.4.1 Installing Packages

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 94

5.4.2 Package Removal

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 96

5.4.3 Querying dpkg’s Database and Inspecting .deb Files

. . . . . . . . . . . . . . . . . . . . . . . . . . 96

5.4.4 dpkg’s Log File

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 101

5.4.5 Multi-Arch Support

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 101

Enabling Multi-Arch

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 101

Multi-Arch Related Changes

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 102

5.5 Coexistence with Other Packaging Systems

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . 103

6. Maintenance and Updates: The APT Tools

6.1 Filling in the sources.list File

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 108

6.1.1 Syntax

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 108

6.1.2 Repositories for

Stable Users

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 110

Security Updates

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 111

Stable Updates

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 111

Proposed Updates

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 112

Stable Backports

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 112

6.1.3 Repositories for

Testing/Unstable Users

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 112

The Experimental Repository

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 113

6.1.4 Using Alternate Mirrors

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 114

6.1.5 Non-Official Resources: mentors.debian.net

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 114

6.1.6 Caching Proxy for Debian Packages

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 115

V

Table of Contents

6.2 aptitude, apt-get, and apt Commands

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 116

6.2.1 Initialization

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 116

6.2.2 Installing and Removing

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 117

6.2.3 System Upgrade

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 120

6.2.4 Configuration Options

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 120

6.2.5 Managing Package Priorities

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 121

6.2.6 Working with Several Distributions

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 124

6.2.7 Tracking Automatically Installed Packages

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 125

6.3 The apt-cache Command

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 126

6.4 The apt-file Command

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 128

6.5 Frontends: aptitude, synaptic

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 128

6.5.1 aptitude

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 128

Managing Recommendations, Suggestions and Tasks

. . . . . . . . . . . . . . . . . . . . . . . . . . 130

Better Solver Algorithms

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 131

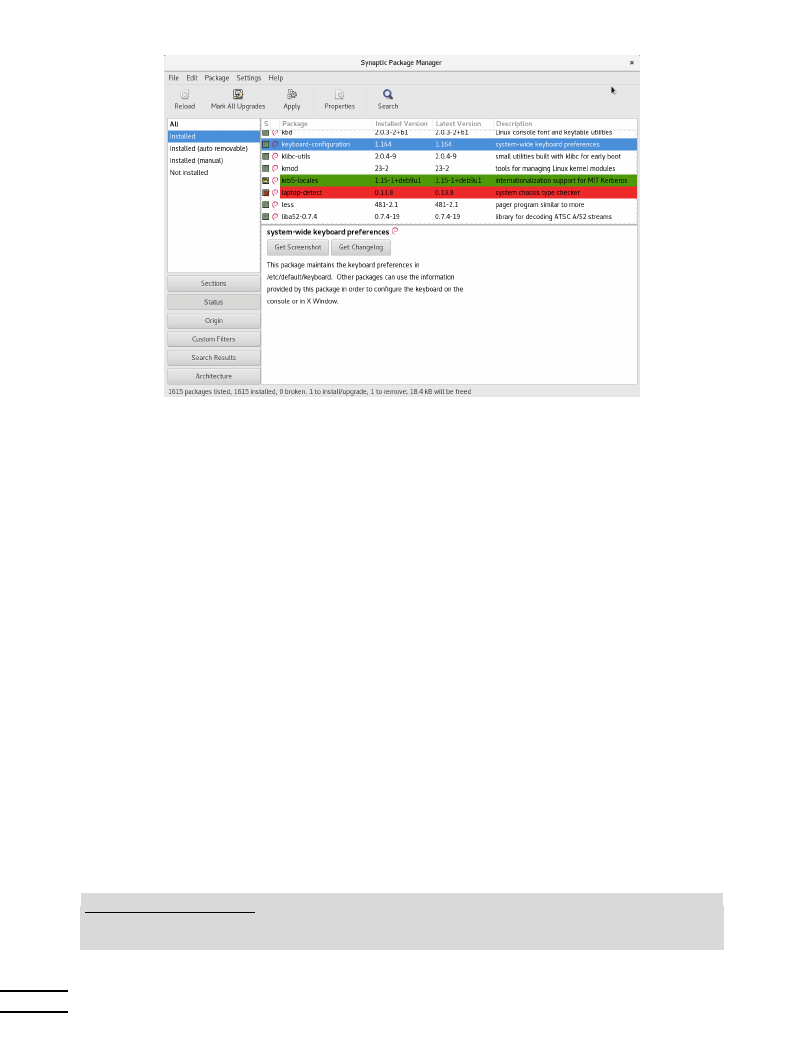

6.5.2 synaptic

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 131

6.6 Checking Package Authenticity

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 132

6.7 Upgrading from One Stable Distribution to the Next

. . . . . . . . . . . . . . . . . . . . . . . . 134

6.7.1 Recommended Procedure

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 134

6.7.2 Handling Problems after an Upgrade

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 135

6.7.3 Cleaning Up after an Upgrade

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 136

Packages removed from the Debian Archive

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 137

Dummy and Transitional Packages

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 137

Old or Unused Configuration Files

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 137

Files not owned by any Package

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 138

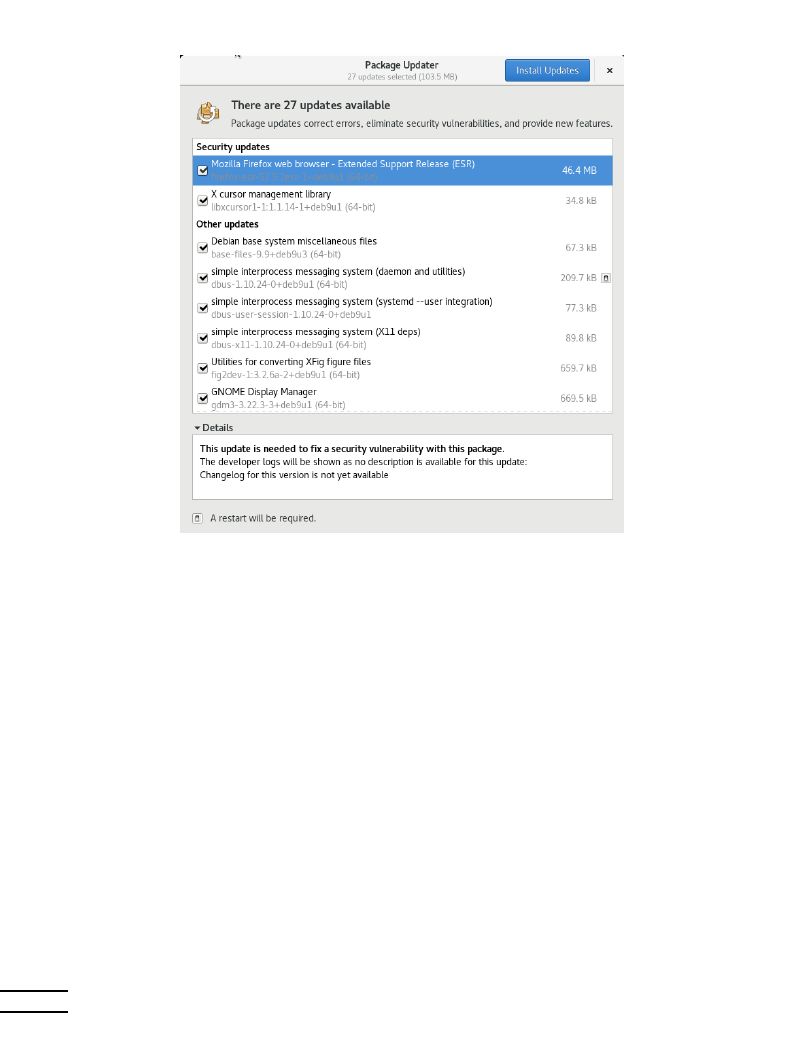

6.8 Keeping a System Up to Date

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 138

6.9 Automatic Upgrades

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 140

6.9.1 Configuring dpkg

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 140

6.9.2 Configuring APT

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 141

6.9.3 Configuring debconf

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 141

6.9.4 Handling Command Line Interactions

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 141

6.9.5 The Miracle Combination

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 141

6.10 Searching for Packages

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 142

7. Solving Problems and Finding Relevant Information

7.1 Documentation Sources

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 148

7.1.1 Manual Pages

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 148

7.1.2

info Documents

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 150

7.1.3 Specific Documentation

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 151

7.1.4 Websites

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 151

7.1.5 Tutorials (

HOWTO)

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 152

7.2 Common Procedures

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 153

7.2.1 Configuring a Program

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 153

7.2.2 Monitoring What Daemons Are Doing

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 154

7.2.3 Asking for Help on a Mailing List

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 155

VI

The Debian Administrator’s Handbook

7.2.4 Reporting a Bug When a Problem Is Too Difficult

. . . . . . . . . . . . . . . . . . . . . . . . . . . . 156

8. Basic Configuration: Network, Accounts, Printing…

8.1 Configuring the System for Another Language

. . . . . . . . . . . . . . . . . . . . . . . . . . . 160

8.1.1 Setting the Default Language

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 160

8.1.2 Configuring the Keyboard

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 161

8.1.3 Migrating to UTF-8

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 162

8.2 Configuring the Network

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 163

8.2.1 Ethernet Interface

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 165

8.2.2 Wireless Interface

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 166

Installing the required firmwares

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 166

Wireless specific entries in /etc/network/interfaces

. . . . . . . . . . . . . . . . . . . . . . . . . 167

8.2.3 Connecting with PPP through a PSTN Modem

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . 167

8.2.4 Connecting through an ADSL Modem

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 168

Modems Supporting PPPOE

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 168

Modems Supporting PPTP

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 169

Modems Supporting DHCP

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 169

8.2.5 Automatic Network Configuration for Roaming Users

. . . . . . . . . . . . . . . . . . . . . . . . . 169

8.3 Setting the Hostname and Configuring the Name Service

. . . . . . . . . . . . . . . . . . . . . 170

8.3.1 Name Resolution

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 171

Configuring DNS Servers

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 171

The /etc/hosts file

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 171

8.4 User and Group Databases

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 172

8.4.1 User List: /etc/passwd

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 173

8.4.2 The Hidden and Encrypted Password File: /etc/shadow

. . . . . . . . . . . . . . . . . . . . . . . . 173

8.4.3 Modifying an Existing Account or Password

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 174

8.4.4 Disabling an Account

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 174

8.4.5 Group List: /etc/group

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 174

8.5 Creating Accounts

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 175

8.6 Shell Environment

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 176

8.7 Printer Configuration

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 178

8.8 Configuring the Bootloader

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 179

8.8.1 Identifying the Disks

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 179

8.8.2 Configuring LILO

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 181

8.8.3 GRUB 2 Configuration

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 182

8.9 Other Configurations: Time Synchronization, Logs, Sharing Access…

. . . . . . . . . . . . . . 183

8.9.1 Timezone

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 183

8.9.2 Time Synchronization

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 184

For Workstations

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 185

For Servers

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 185

8.9.3 Rotating Log Files

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 186

8.9.4 Sharing Administrator Rights

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 186

8.9.5 List of Mount Points

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 186

8.9.6 locate and updatedb

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 189

VII

Table of Contents

8.10 Compiling a Kernel

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 189

8.10.1 Introduction and Prerequisites

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 189

8.10.2 Getting the Sources

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 190

8.10.3 Configuring the Kernel

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 191

8.10.4 Compiling and Building the Package

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 192

8.10.5 Compiling External Modules

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 192

8.10.6 Applying a Kernel Patch

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 193

8.11 Installing a Kernel

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 194

8.11.1 Features of a Debian Kernel Package

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 194

8.11.2 Installing with dpkg

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 195

9. Unix Services

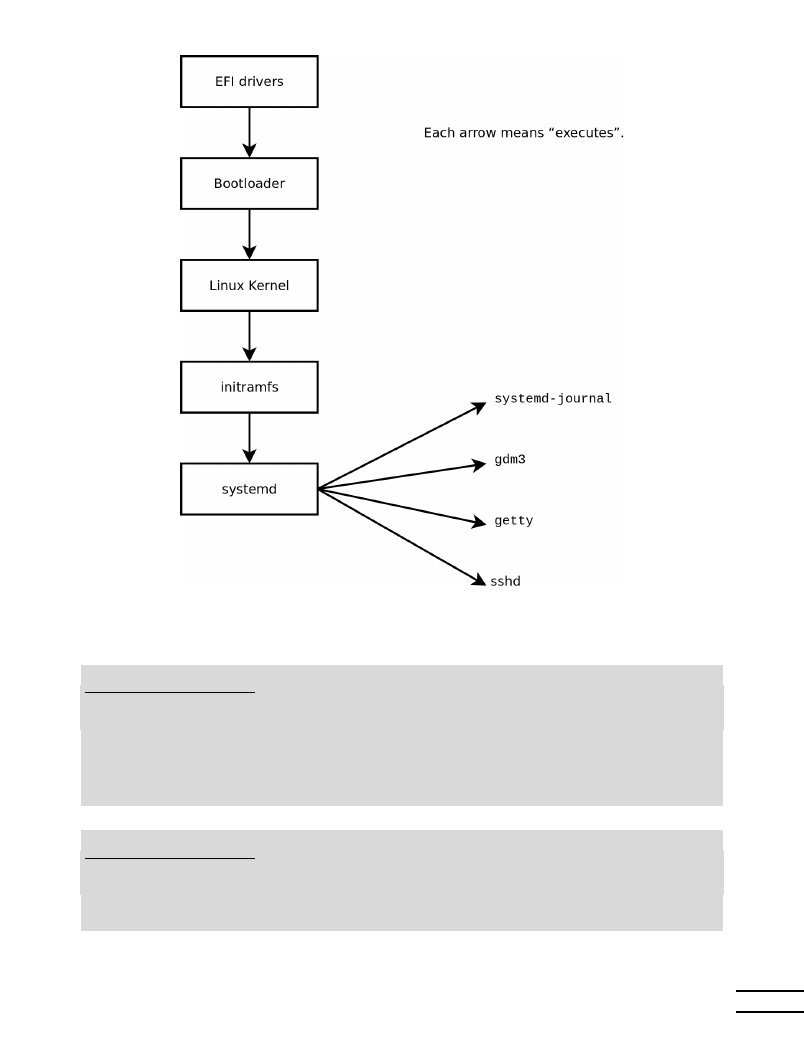

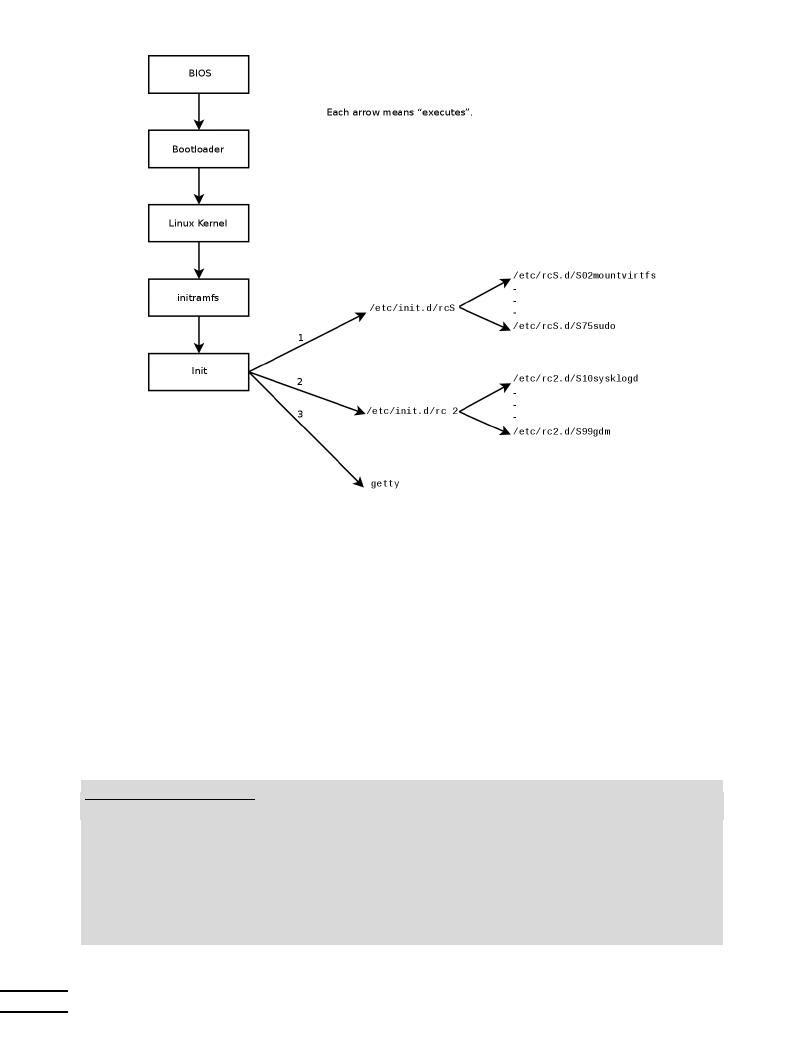

9.1 System Boot

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 198

9.1.1 The systemd init system

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 198

9.1.2 The System V init system

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 204

9.2 Remote Login

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 207

9.2.1 Secure Remote Login: SSH

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 207

Key-Based Authentication

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 208

Using Remote X11 Applications

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 210

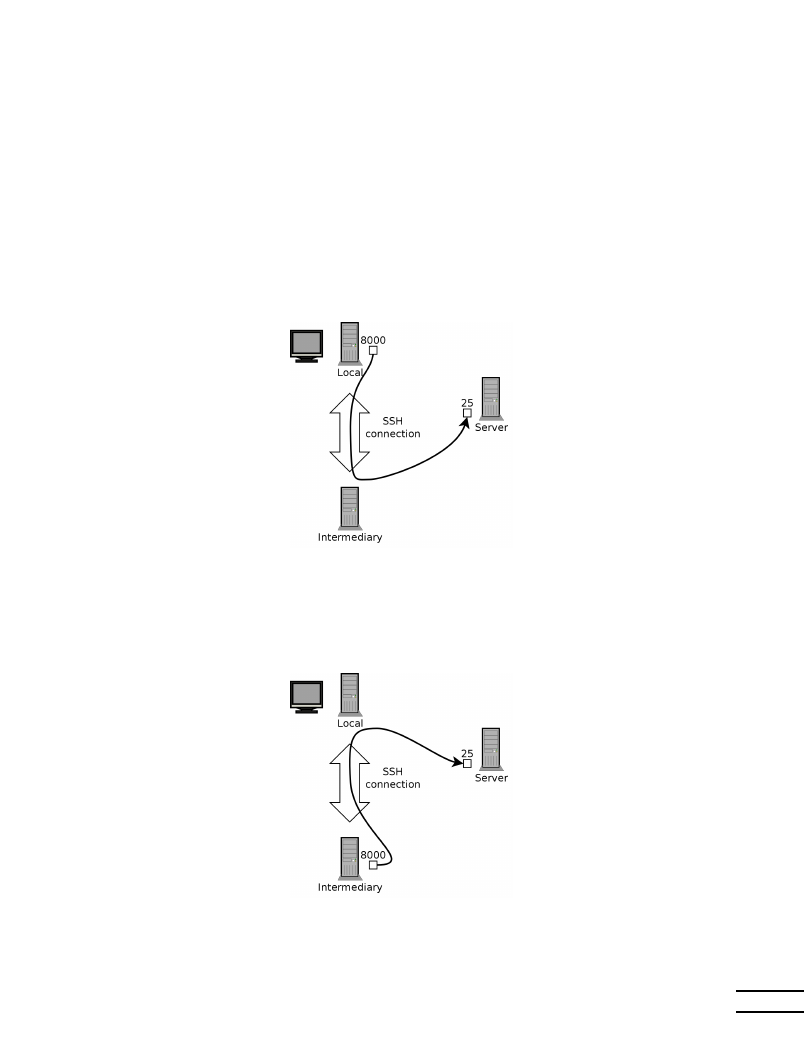

Creating Encrypted Tunnels with Port Forwarding

. . . . . . . . . . . . . . . . . . . . . . . . . . . 210

9.2.2 Using Remote Graphical Desktops

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 212

9.3 Managing Rights

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 213

9.4 Administration Interfaces

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 215

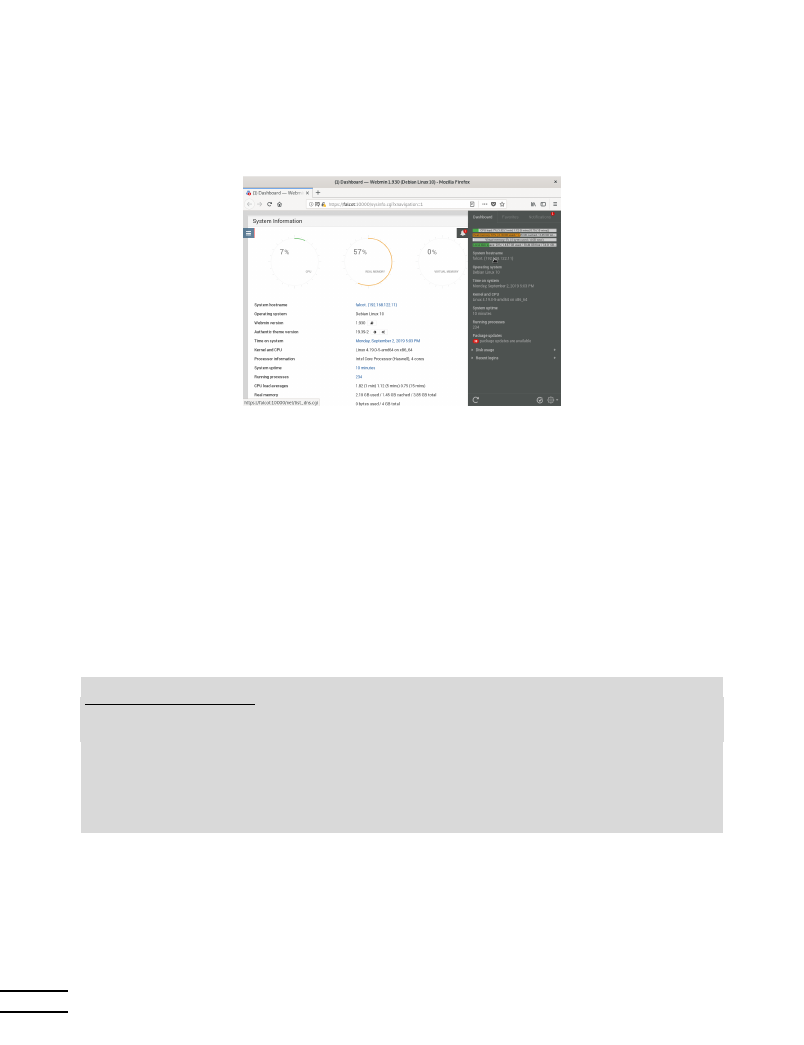

9.4.1 Administrating on a Web Interface: webmin

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 216

9.4.2 Configuring Packages: debconf

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 217

9.5 syslog System Events

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 218

9.5.1 Principle and Mechanism

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 218

9.5.2 The Configuration File

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 219

Syntax of the Selector

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 219

Syntax of Actions

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 219

9.6 The inetd Super-Server

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 220

9.7 Scheduling Tasks with cron and atd

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 222

9.7.1 Format of a crontab File

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 222

9.7.2 Using the at Command

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 224

9.8 Scheduling Asynchronous Tasks: anacron

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 225

9.9 Quotas

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 226

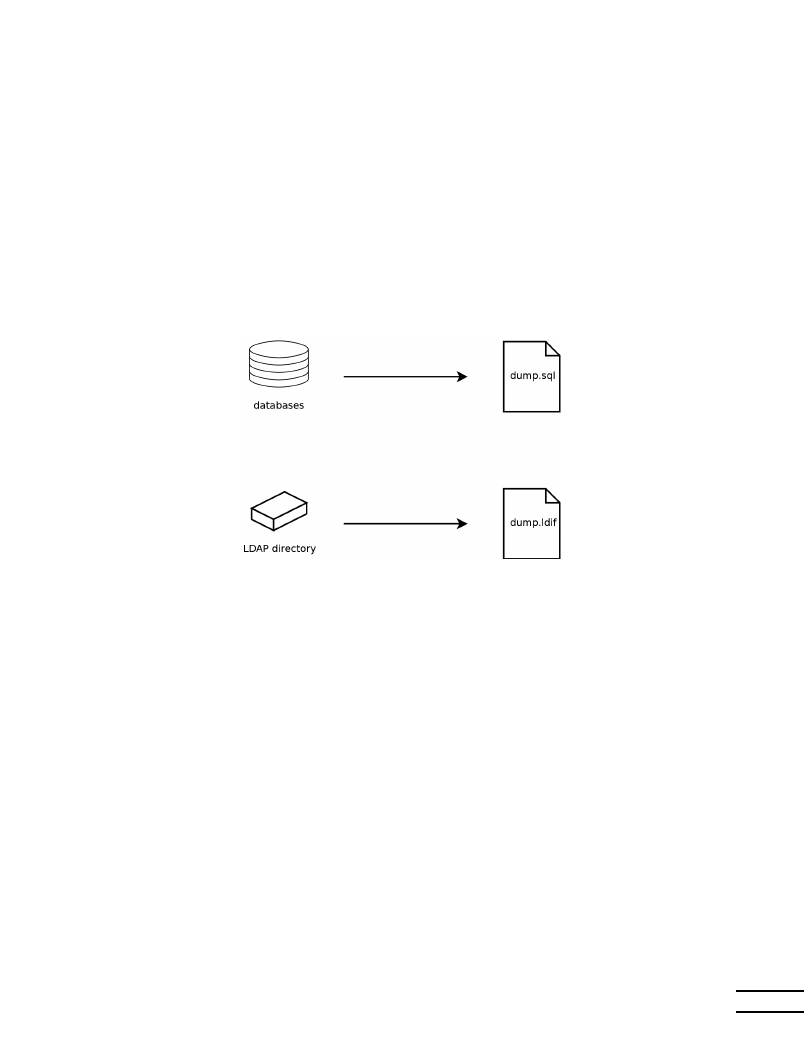

9.10 Backup

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 227

9.10.1 Backing Up with rsync

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 227

9.10.2 Restoring Machines without Backups

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 229

9.11 Hot Plugging:

hotplug

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 230

9.11.1 Introduction

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 230

9.11.2 The Naming Problem

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 230

9.11.3 How

udev Works

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 231

9.11.4 A concrete example

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 232

VIII

The Debian Administrator’s Handbook

9.12 Power Management: Advanced Configuration and Power Interface (ACPI)

. . . . . . . . . . 234

10. Network Infrastructure

10.1 Gateway

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 238

10.2 X.509 certificates

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 240

10.2.1 Creating gratis trusted certificates

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 240

10.2.2 Public Key Infrastructure:

easy-rsa

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 243

10.3 Virtual Private Network

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 247

10.3.1 OpenVPN

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 247

Configuring the OpenVPN Server

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 248

Configuring the OpenVPN Server

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 248

Configuring the OpenVPN Client

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 249

10.3.2 Virtual Private Network with SSH

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 249

10.3.3 IPsec

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 250

10.3.4 PPTP

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 250

Configuring the Client

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 251

Configuring the Server

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 252

10.4 Quality of Service

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 254

10.4.1 Principle and Mechanism

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 254

10.4.2 Configuring and Implementing

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 255

Reducing Latencies: wondershaper

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 255

Standard Configuration

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 256

10.5 Dynamic Routing

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 256

10.6 IPv6

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 257

10.6.1 Tunneling

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 258

10.7 Domain Name Servers (DNS)

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 259

10.7.1 DNS software

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 260

10.7.2 Configuring bind

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 260

10.8 DHCP

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 263

10.8.1 Configuring

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 263

10.8.2 DHCP and DNS

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 264

10.9 Network Diagnosis Tools

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 264

10.9.1 Local Diagnosis: netstat

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 265

10.9.2 Remote Diagnosis: nmap

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 266

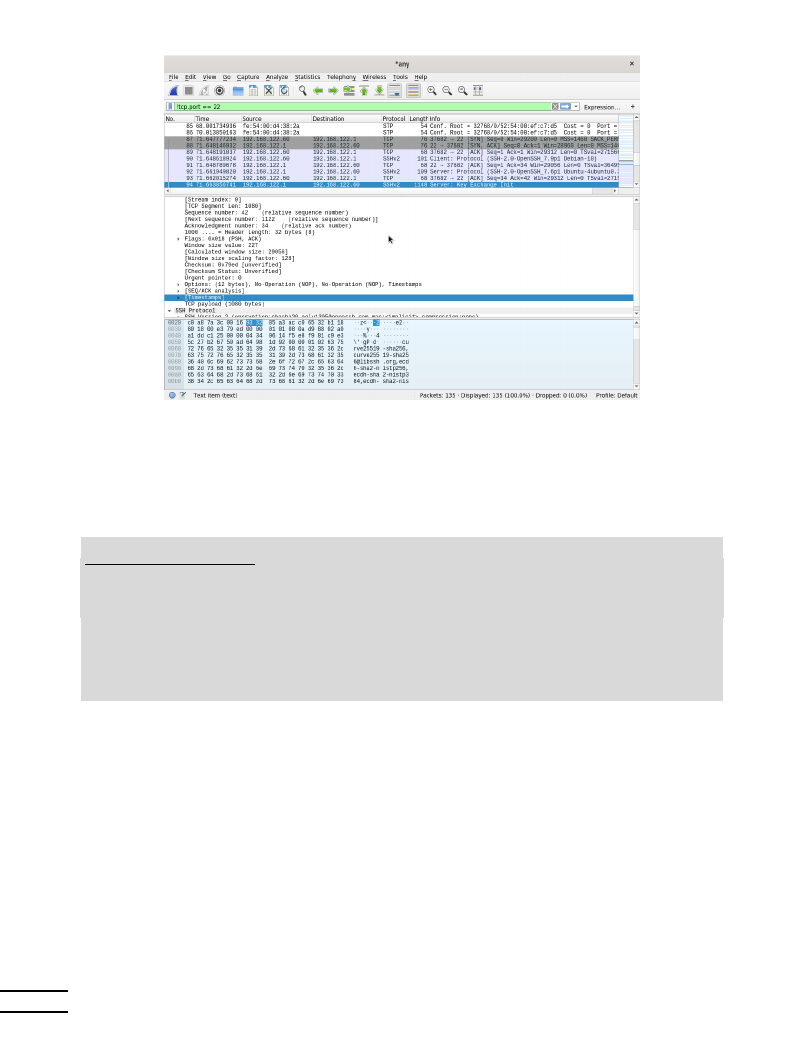

10.9.3 Sniffers: tcpdump and wireshark

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 267

11. Network Services: Postfix, Apache, NFS, Samba, Squid,

LDAP, SIP, XMPP, TURN

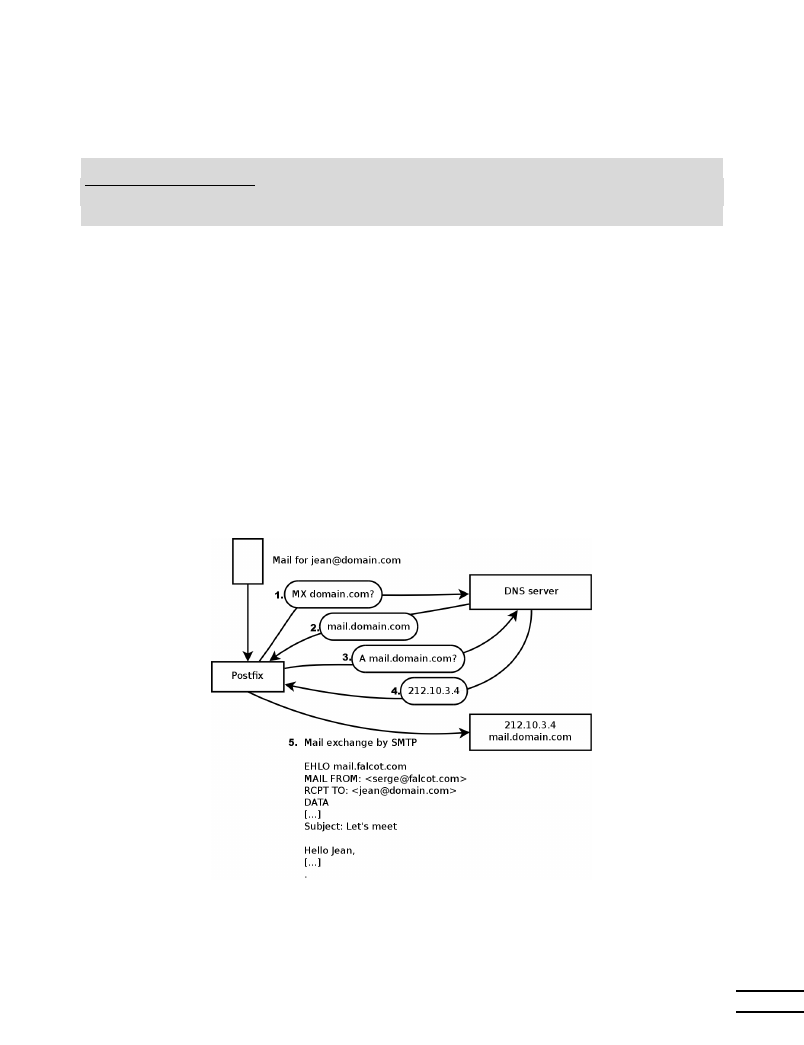

11.1 Mail Server

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 272

11.1.1 Installing Postfix

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 272

11.1.2 Configuring Virtual Domains

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 275

Virtual Alias Domains

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 276

Virtual Mailbox Domains

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 276

11.1.3 Restrictions for Receiving and Sending

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 277

IP-Based Access Restrictions

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 278

IX

Table of Contents

Checking the Validity of the EHLO or HELO Commands

. . . . . . . . . . . . . . . . . . . . . . . . 279

Accepting or Refusing Based on the Announced Sender

. . . . . . . . . . . . . . . . . . . . . . . . . 280

Accepting or Refusing Based on the Recipient

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . 281

Restrictions Associated with the DATA Command

. . . . . . . . . . . . . . . . . . . . . . . . . . . 281

Applying Restrictions

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 282

Filtering Based on the Message Contents

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 282

11.1.4 Setting Up

greylisting

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 283

11.1.5 Customizing Filters Based On the Recipient

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 285

11.1.6 Integrating an Antivirus

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 286

11.1.7 Fighting Spam with SPF, DKIM and DMARC

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . 287

Integrating the Sender Policy Framework (SPF)

. . . . . . . . . . . . . . . . . . . . . . . . . . . . 287

Integrating DomainKeys (DKIM) Signing and Checking

. . . . . . . . . . . . . . . . . . . . . . . . . 288

Integrating Domain-based Message Authentication, Reporting and Conformance (DMARC)

. . . . . . . . 290

11.1.8 Authenticated SMTP

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 291

11.2 Web Server (HTTP)

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 293

11.2.1 Installing Apache

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 293

11.2.2 Adding support for SSL

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 294

11.2.3 Configuring Virtual Hosts

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 295

11.2.4 Common Directives

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 296

Requiring Authentication

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 297

Restricting Access

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 298

11.2.5 Log Analyzers

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 299

11.3 FTP File Server

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 301

11.4 NFS File Server

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 302

11.4.1 Securing NFS

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 302

11.4.2 NFS Server

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 303

11.4.3 NFS Client

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 304

11.5 Setting Up Windows Shares with Samba

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 305

11.5.1 Samba Server

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 305

Configuring with debconf

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 305

Configuring Manually

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 306

11.5.2 Samba Client

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 307

The smbclient Program

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 307

Mounting Windows Shares

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 307

Printing on a Shared Printer

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 308

11.6 HTTP/FTP Proxy

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 308

11.6.1 Installing

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 309

11.6.2 Configuring a Cache

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 309

11.6.3 Configuring a Filter

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 310

11.7 LDAP Directory

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 310

11.7.1 Installing

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 311

11.7.2 Filling in the Directory

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 312

11.7.3 Managing Accounts with LDAP

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 313

X

The Debian Administrator’s Handbook

Configuring NSS

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 313

Configuring PAM

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 315

Securing LDAP Data Exchanges

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 316

11.8 Real-Time Communication Services

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 319

11.8.1 DNS settings for RTC services

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 320

11.8.2 TURN Server

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 320

11.8.3 SIP Proxy Server

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 321

Install the SIP proxy

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 321

11.8.4 XMPP Server

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 322

Install the XMPP server

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 322

Managing the XMPP server

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 323

11.8.5 Running services on port 443

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 323

11.8.6 Adding WebRTC

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 324

12. Advanced Administration

12.1 RAID and LVM

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 328

12.1.1 Software RAID

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 328

Different RAID Levels

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 329

Setting up RAID

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 331

Backing up the Configuration

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 337

12.1.2 LVM

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 339

LVM Concepts

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 339

Setting up LVM

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 340

LVM Over Time

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 344

12.1.3 RAID or LVM?

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 346

12.2 Virtualization

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 349

12.2.1 Xen

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 350

12.2.2 LXC

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 356

Preliminary Steps

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 356

Network Configuration

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 357

Setting Up the System

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 358

Starting the Container

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 359

12.2.3 Virtualization with KVM

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 360

Preliminary Steps

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 361

Network Configuration

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 361

Installation with virt-install

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 361

Managing Machines with virsh

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 363

Installing an RPM based system in Debian with yum

. . . . . . . . . . . . . . . . . . . . . . . . . . 364

12.3 Automated Installation

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 365

12.3.1 Fully Automatic Installer (FAI)

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 366

12.3.2 Preseeding Debian-Installer

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 367

Using a Preseed File

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 367

Creating a Preseed File

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 368

Creating a Customized Boot Media

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 368

XI

Table of Contents

12.3.3 Simple-CDD: The All-In-One Solution

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 370

Creating Profiles

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 370

Configuring and Using build-simple-cdd

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 371

Generating an ISO Image

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 371

12.4 Monitoring

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 371

12.4.1 Setting Up Munin

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 372

Configuring Hosts To Monitor

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 372

Configuring the Grapher

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 374

12.4.2 Setting Up Nagios

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 374

Installing

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 375

Configuring

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 375

13. Workstation

13.1 Configuring the X11 Server

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 382

13.2 Customizing the Graphical Interface

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 383

13.2.1 Choosing a Display Manager

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 383

13.2.2 Choosing a Window Manager

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 383

13.2.3 Menu Management

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 384

13.3 Graphical Desktops

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 385

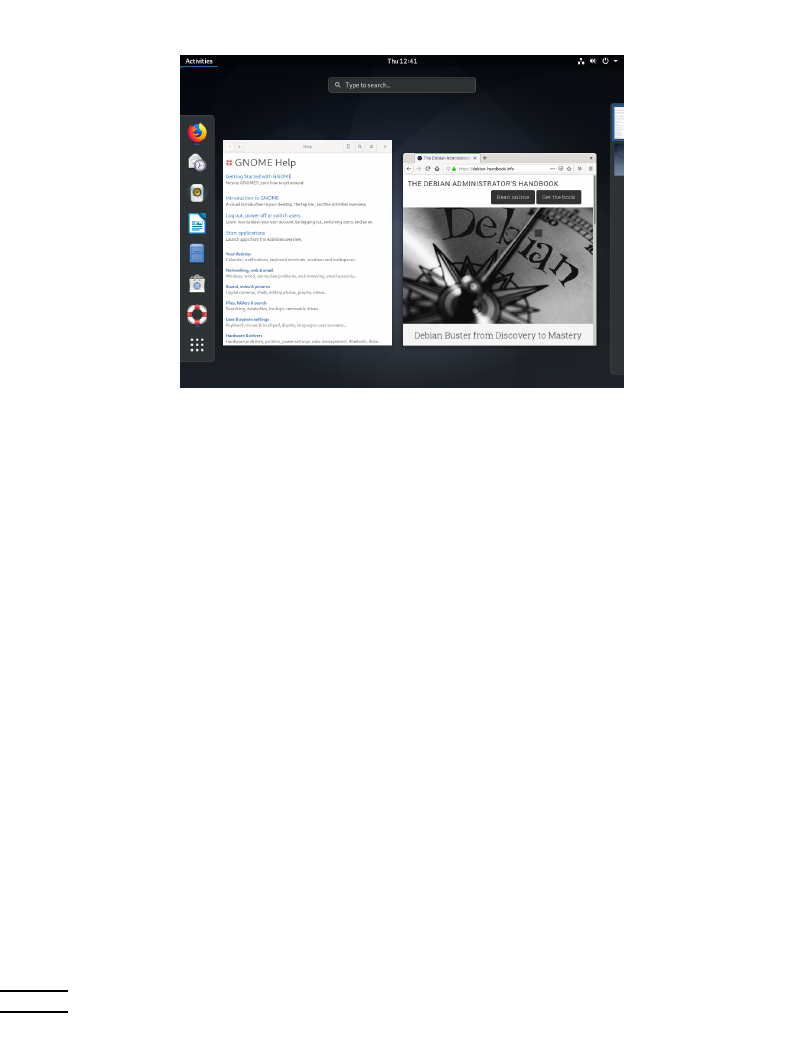

13.3.1 GNOME

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 385

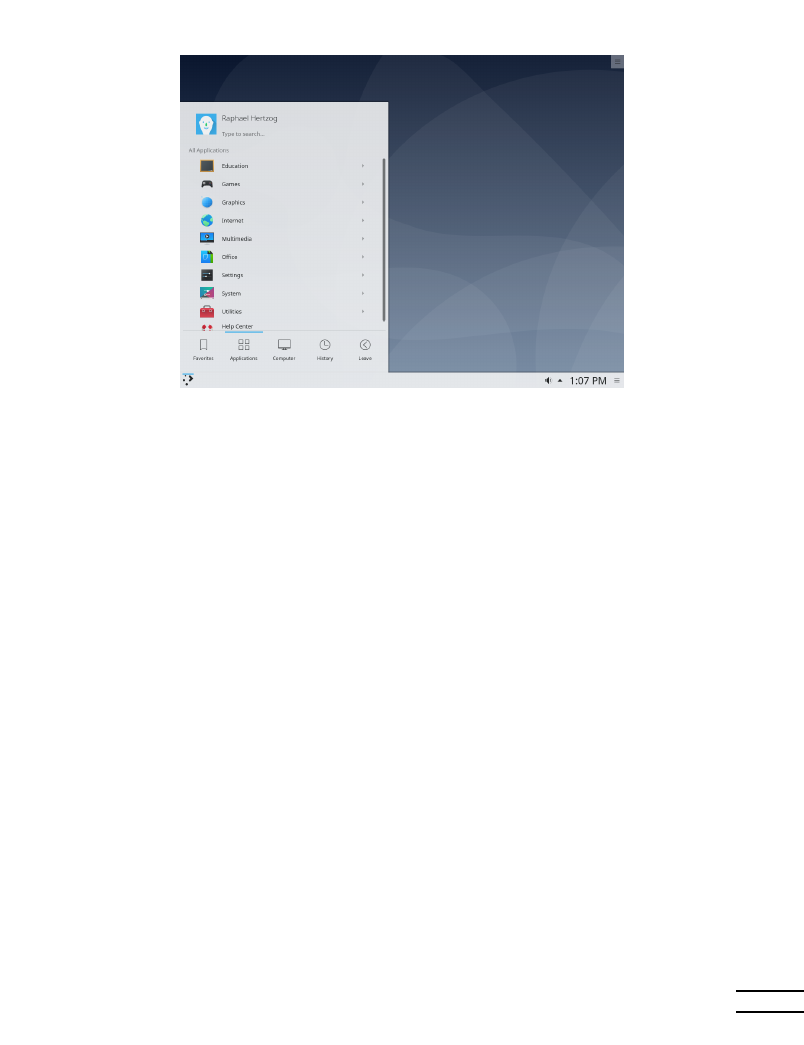

13.3.2 KDE and Plasma

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 386

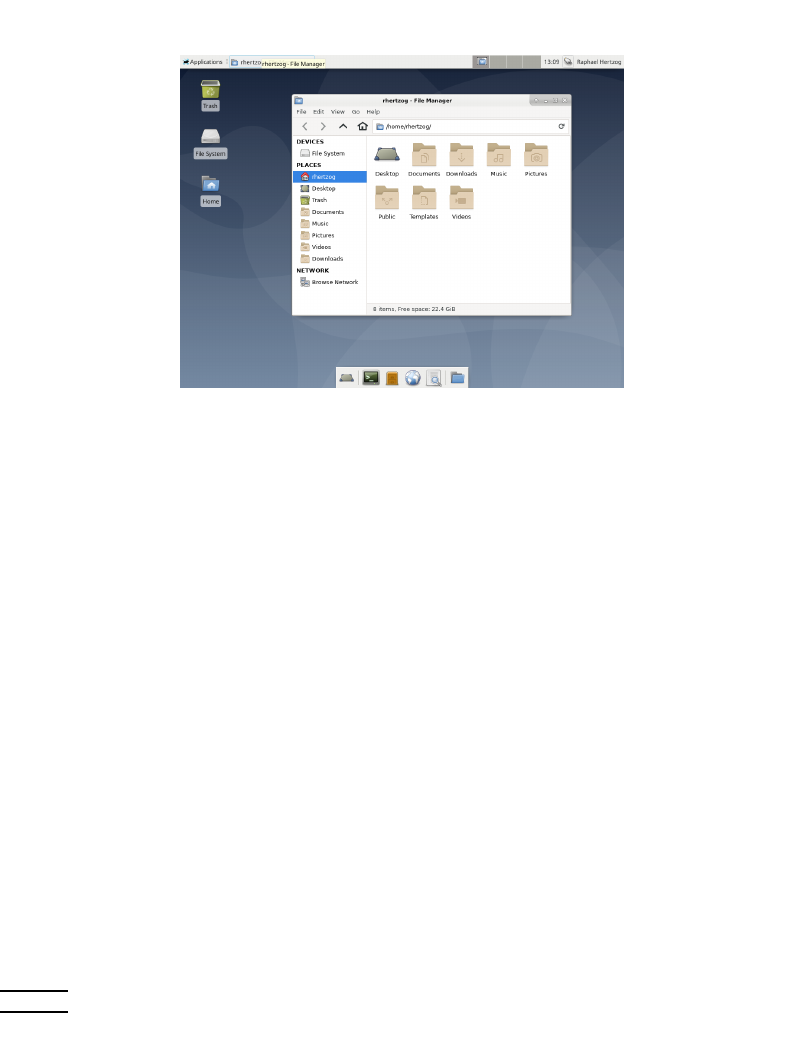

13.3.3 Xfce and Others

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 387

13.3.4 Other Desktop Environments

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 388

13.4 Email

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 389

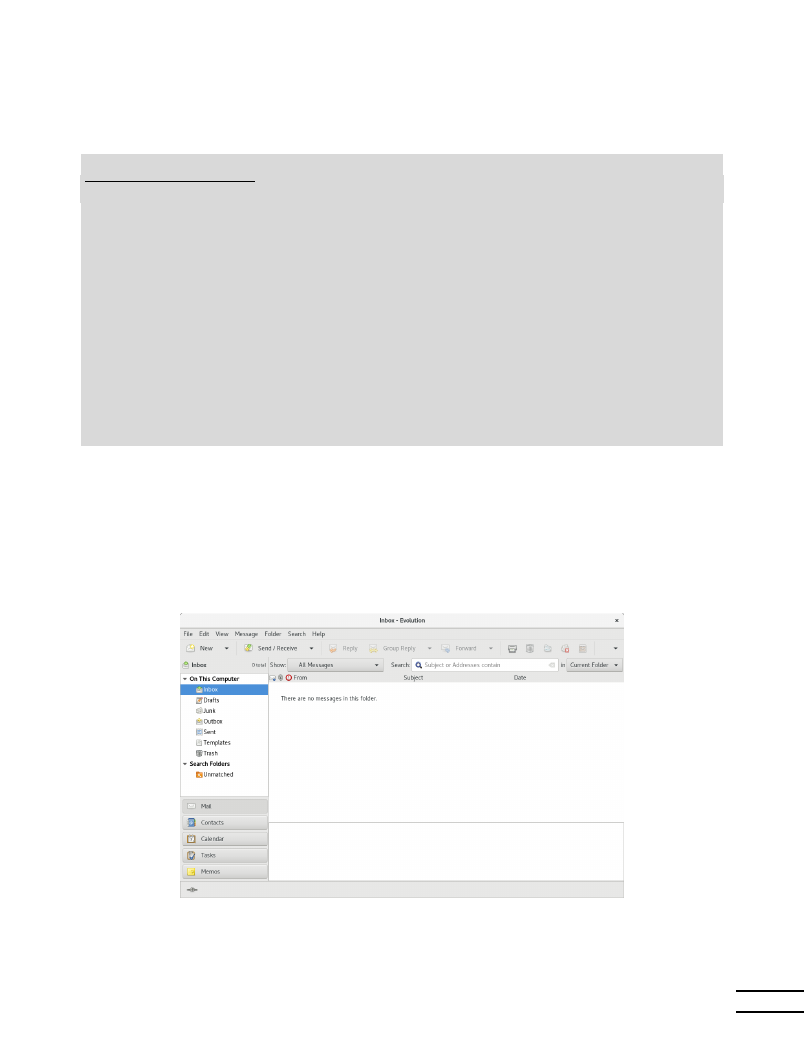

13.4.1 Evolution

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 389

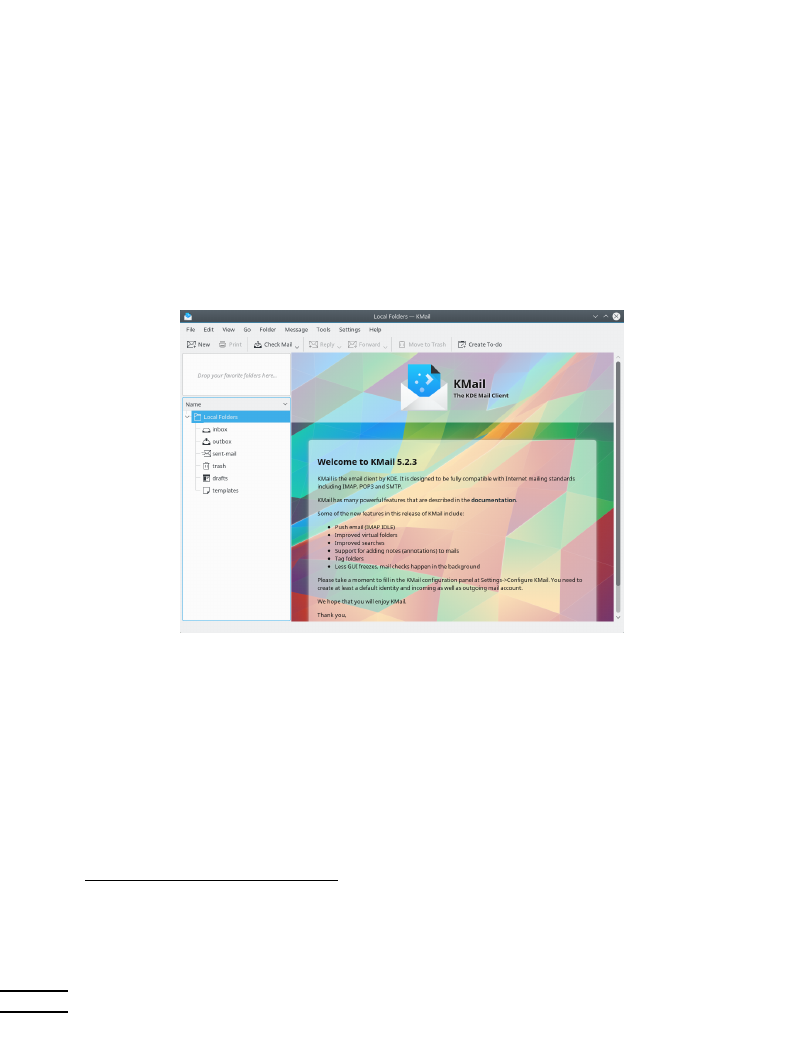

13.4.2 KMail

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 390

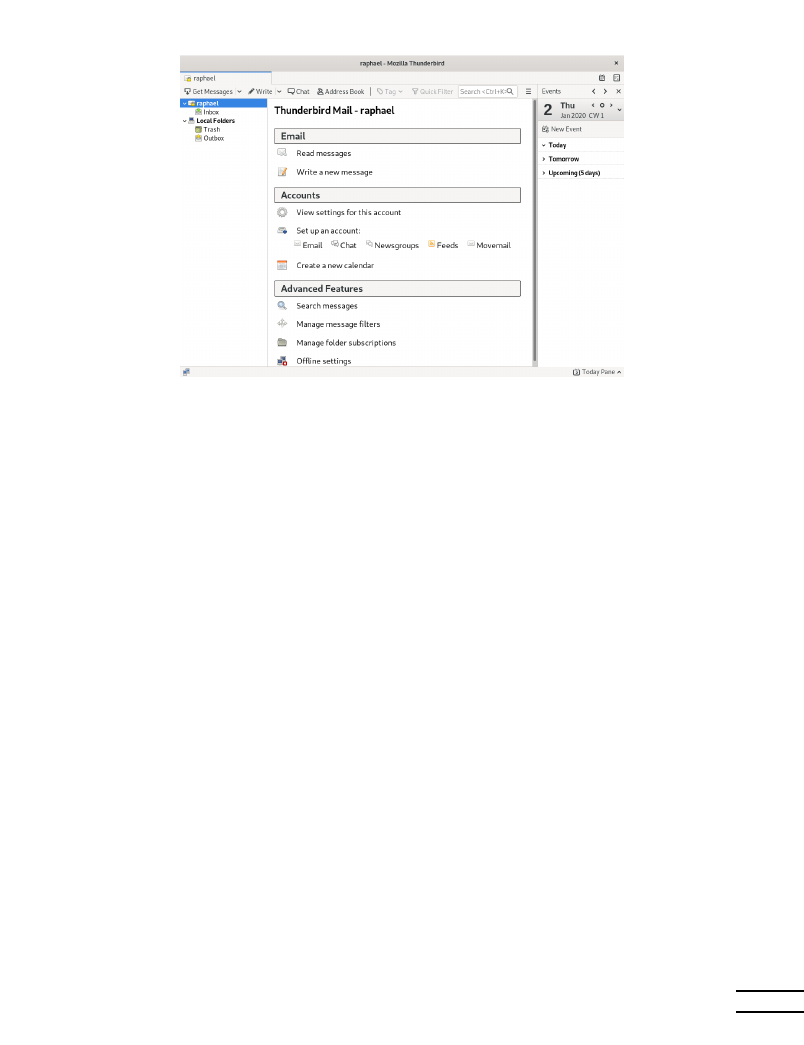

13.4.3 Thunderbird

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 390

13.5 Web Browsers

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 391

13.6 Development

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 393

13.6.1 Tools for GTK+ on GNOME

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 393

13.6.2 Tools for Qt

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 393

13.7 Collaborative Work

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 394

13.7.1 Working in Groups:

groupware

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 394

13.7.2 Collaborative Work With FusionForge

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 394

13.8 Office Suites

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 395

13.9 Emulating Windows: Wine

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 396

13.10 Real-Time Communications software

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 397

14. Security

14.1 Defining a Security Policy

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 402

14.2 Firewall or Packet Filtering

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 403

14.2.1 nftables Behavior

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 404

14.2.2 Moving from iptables to nftables

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 406

14.2.3 Syntax of nft

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 408

14.2.4 Installing the Rules at Each Boot

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 409

XII

The Debian Administrator’s Handbook

14.3 Supervision: Prevention, Detection, Deterrence

. . . . . . . . . . . . . . . . . . . . . . . . . . 410

14.3.1 Monitoring Logs with logcheck

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 410

14.3.2 Monitoring Activity

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 411

In Real Time

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 411

History

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 411

14.3.3 Avoiding Intrusion

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 412

14.3.4 Detecting Changes

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 413

Auditing Packages with dpkg --verify

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 413

Auditing Packages: debsums and its Limits

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 414

Monitoring Files: AIDE

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 414

14.3.5 Detecting Intrusion (IDS/NIDS)

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 416

14.4 Introduction to AppArmor

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 417

14.4.1 Principles

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 417

14.4.2 Enabling AppArmor and managing AppArmor profiles

. . . . . . . . . . . . . . . . . . . . . . . . . 417

14.4.3 Creating a new profile

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 418

14.5 Introduction to SELinux

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 424

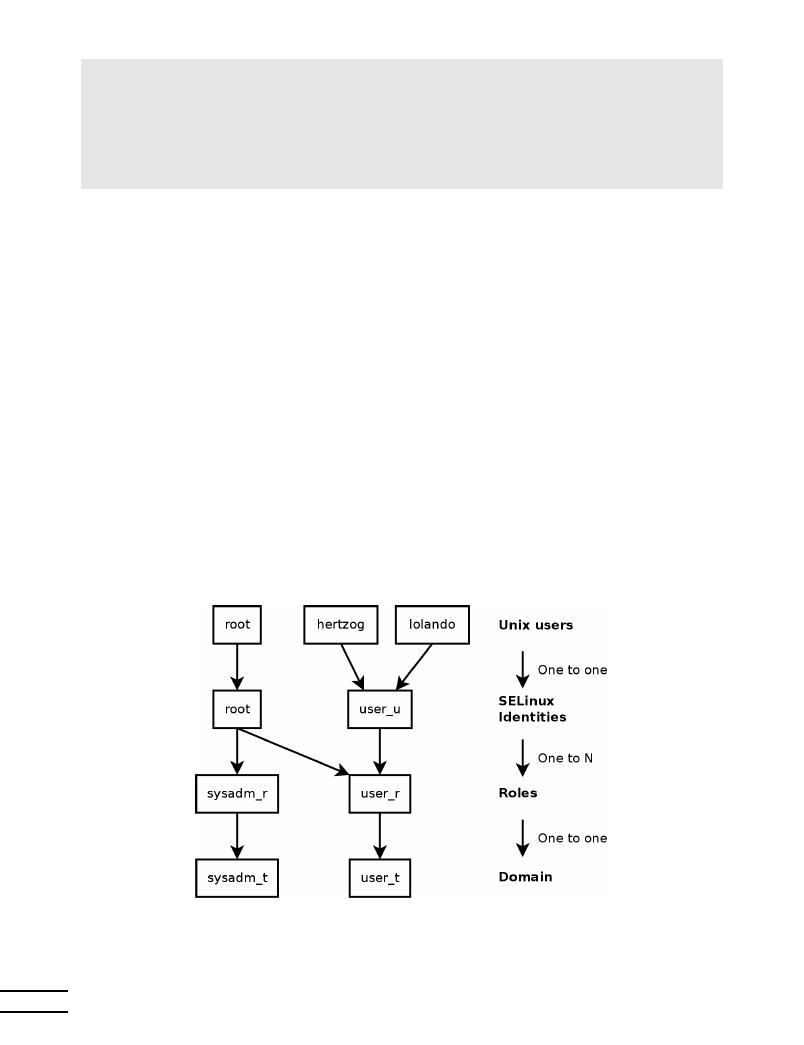

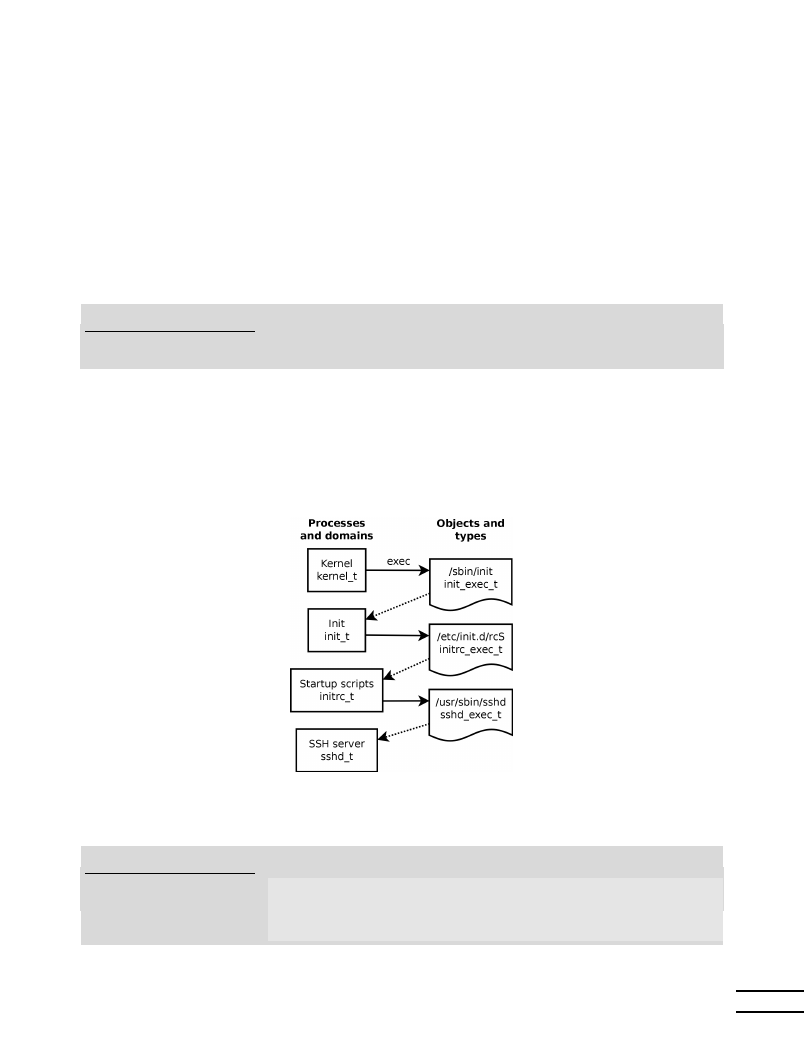

14.5.1 Principles

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 424

14.5.2 Setting Up SELinux

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 426

14.5.3 Managing an SELinux System

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 427

Managing SELinux Modules

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 427

Managing Identities

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 428

Managing File Contexts, Ports and Booleans

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 429

14.5.4 Adapting the Rules

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 430

Writing a .fc file

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 430

Writing a .if File

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 430

Writing a .te File

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 432

Compiling the Files

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 435

14.6 Other Security-Related Considerations

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 435

14.6.1 Inherent Risks of Web Applications

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 435

14.6.2 Knowing What To Expect

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 436

14.6.3 Choosing the Software Wisely

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 437

14.6.4 Managing a Machine as a Whole

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 438

14.6.5 Users Are Players

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 438

14.6.6 Physical Security

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 439

14.6.7 Legal Liability

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 439

14.7 Dealing with a Compromised Machine

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 440

14.7.1 Detecting and Seeing the Cracker’s Intrusion

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . 440

14.7.2 Putting the Server Off-Line

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 440

14.7.3 Keeping Everything that Could Be Used as Evidence

. . . . . . . . . . . . . . . . . . . . . . . . . . 441

14.7.4 Re-installing

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 442

14.7.5 Forensic Analysis

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 442

14.7.6 Reconstituting the Attack Scenario

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 443

15. Creating a Debian Package

XIII

Table of Contents

15.1 Rebuilding a Package from its Sources

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 448

15.1.1 Getting the Sources

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 448

15.1.2 Making Changes

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 448

15.1.3 Starting the Rebuild

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 450

15.2 Building your First Package

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 451

15.2.1 Meta-Packages or Fake Packages

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 451

15.2.2 Simple File Archive

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 452

15.3 Creating a Package Repository for APT

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 456

15.4 Becoming a Package Maintainer

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 458

15.4.1 Learning to Make Packages

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 458

Rules

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 458

Procedures

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 459

Tools

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 459

15.4.2 Acceptance Process

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 461

Prerequisites

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 461

Registration

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 461

Accepting the Principles

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 462

Checking Skills

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 462

Final Approval

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 463

16. Conclusion: Debian’s Future

16.1 Upcoming Developments

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 466

16.2 Debian’s Future

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 466

16.3 Future of this Book

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 467

A. Derivative Distributions

A.1 Census and Cooperation

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 469

A.2 Ubuntu

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 469

A.3 Linux Mint

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 470

A.4 Knoppix

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 471

A.5 Aptosid and Siduction

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 471

A.6 Grml

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 472

A.7 Tails

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 472

A.8 Kali Linux

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 472

A.9 Devuan

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 472

A.10 DoudouLinux

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 472

A.11 Raspbian

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 473

A.12 PureOS

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 473

A.13 SteamOS

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 473

A.14 And Many More

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 473

B. Short Remedial Course

B.1 Shell and Basic Commands

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 475

B.1.1 Browsing the Directory Tree and Managing Files

. . . . . . . . . . . . . . . . . . . . . . . . . . . . 475

B.1.2 Displaying and Modifying Text Files

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 476

XIV

The Debian Administrator’s Handbook

B.1.3 Searching for Files and within Files

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 477

B.1.4 Managing Processes

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 477

B.1.5 System Information: Memory, Disk Space, Identity

. . . . . . . . . . . . . . . . . . . . . . . . . . . 477

B.2 Organization of the Filesystem Hierarchy

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 478

B.2.1 The Root Directory

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 478

B.2.2 The User’s Home Directory

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 479

B.3 Inner Workings of a Computer: the Different Layers Involved

. . . . . . . . . . . . . . . . . . 480

B.3.1 The Deepest Layer: the Hardware

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 480

B.3.2 The Starter: the BIOS or UEFI

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 481

B.3.3 The Kernel

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 482

B.3.4 The User Space

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 482

B.4 Some Tasks Handled by the Kernel

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 482

B.4.1 Driving the Hardware

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 482

B.4.2 Filesystems

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 483

B.4.3 Shared Functions

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 484

B.4.4 Managing Processes

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 484

B.4.5 Rights Management

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 485

B.5 The User Space

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 485

B.5.1 Process

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 486

B.5.2 Daemons

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 486

B.5.3 Inter-Process Communications

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 487

B.5.4 Libraries

. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 488

Index

XV

Table of Contents

Preface

I’m pleased to have this opportunity to welcome you to Debian and the Debian Administrator’s

Handbook. Many people have chosen Debian: around 10% of the web servers on the Internet

run Debian. When you include operating systems based on Debian, this number is closer to

20%. Debian was selected as the operating system of choice for the International Space Station.

Whether it is cutting edge physics research or a project to help grow food while fighting pollu-

tion, Debian has been used to power the computers that make it possible.

Why does Debian have appeal across large corporations, researchers, activists and hobbyists? I

think that the answer lies in Debian’s flexibility and community.

Debian is flexible. Yes, it provides an excellent general-purpose operating system out of the

box. It also provides the tools to customize Debian to whatever environment you find yourself

working in. Whether it is a cloud and container architecture, a large collection of workstations,

individual computers, or an appliance, Debian provides the flexibility to work well in that envi-

ronment. You will find the tools and examples you need to meet your needs.

The Debian community is a meeting place for diverse individuals and interests: developers from

the largest corporations work alongside volunteers, researchers, and users. Whether it is secu-

rity experts, web developers, systems programmers or architects, we are all represented. You

can be part of this community. When you find ways that Debian can be better, we welcome your

contribution.

We come together to produce a world-class free operating system. No one company controls

Debian; no one agenda defines our work. Instead, each of us has the power to improve Debian

in the ways that matter to us. Thank you for taking a look at what we’ve built. I hope you like

it.

This book is an excellent way to explore Debian. I’ve been recommending it to friends for years

when they wanted to learn more about Debian, and I am pleased to have the opportunity to rec-

ommend it more widely. This handbook is written and maintained by long-standing members

of the Debian community. Some of the same people who are working to develop the operating

system have joined together to help you understand it. And of course the book is developed

using a community process similar to Debian itself with the same emphasis on freedom.

August 2019

Sam Hartman (Debian Project Leader)

Foreword

Linux has been garnering strength for a number of years now, and its growing popularity drives

more and more users to make the jump. The first step on that path is to pick a distribution.

This is an important decision, because each distribution has its own peculiarities, and future

migration costs can be avoided if the right choice is made from the start.

BACK TO BASICS

Linux distribution, Linux

kernel

Strictly speaking, Linux is only a kernel, the core piece of software which sits be-

tween the hardware and the applications.

A “Linux distribution” is a full operating system; it usually includes the Linux ker-

nel, an installer program, and most importantly applications and other software

required to turn a computer into a tool that is actually useful.

Debian GNU/Linux is a “generic” Linux distribution that fits most users. The purpose of this

book is to show its many aspects so that you can make an informed decision when choosing.

Why This Book?

CULTURE

Commercial distributions

Most Linux distributions are backed by a for-profit company that develops them

and sells them under some kind of commercial scheme. Examples include

Ubuntu,

mainly developed by

Canonical Ltd.; Red Hat Enterprise Linux, by Red Hat; and

SUSE Linux, maintained and made commercially available by Novell.

At the other end of the spectrum lie the likes of Debian and the Apache Software

Foundation (which hosts the development for the Apache web server). Debian is

above all a project in the Free Software world, implemented by volunteers working

together through the Internet. While some of them do work on Debian as part

of their paid job in various companies, the project as a whole is not attached to

any company in particular, nor does any one company have a greater say in the

project’s affairs than what purely volunteer contributors have.

Linux has gathered a fair amount of media coverage over the years; it mostly benefits the distri-

butions supported by a real marketing department — in other words, company-backed distribu-

tions (Ubuntu, Red Hat, SUSE, and so on). But Debian is far from being a marginal distribution;

multiple studies have shown over the years that it is widely used both on servers and on desk-

tops. This is particularly true among web servers where Debian and Ubuntu are the leading

Linux distributions.

è https://w3techs.com/technologies/details/os-linux/all/all

The purpose of this book is to help you discover this distribution. We hope to share the experi-

ence that we have gathered since we joined the project as developers and contributors in 1998

(Raphaël) and 2000 (Roland). With any luck, our enthusiasm will be communicative, and maybe

you will join us sometime…

The first edition of this book (in 2004) served to fill a gaping hole: it was the first French-

language book that focused exclusively on Debian. At that time, many other books were writ-

ten on the topic both for French-speaking and English-speaking readers. Unfortunately almost

none of them got updated, and over the years the situation slipped back to one where there

were very few good books on Debian. We hope that this book, which has started a new life with

its translation into English (and several translations from English into various other languages),

will fill this gap and help many users.

Who Is this Book For?

We tried to make this book useful for many categories of readers. First, systems administrators

(both beginners and experienced) will find explanations about the installation and deployment

of Debian on many computers. They will also get a glimpse of most of the services available on

Debian, along with matching configuration instructions and a description of the specifics com-

ing from the distribution. Understanding the mechanisms involved in Debian’s development

will enable them to deal with unforeseen problems, knowing that they can always find help

within the community.

Users of another Linux distribution, or of another Unix variant, will discover the specifics of

Debian, and should become operational very quickly while benefiting fully from the unique

advantages of this distribution.

Finally, readers who already have some knowledge of Debian and want to know more about the

community behind it should see their expectations fulfilled. This book should make them much

closer to joining us as contributors.

General Approach

All of the generic documentation you can find about GNU/Linux also applies to Debian, since

Debian includes most common free software. However, the distribution brings many enhance-

ments, which is why we chose to primarily describe the “Debian way” of doing things.

It is interesting to follow the Debian recommendations, but it is even better to understand their

rationale. Therefore, we won’t restrict ourselves to practical explanations only; we will also

describe the project’s workings, so as to provide you with comprehensive and consistent knowl-

edge.

XX

The Debian Administrator’s Handbook

Book Structure

This book is built around a case study providing both support and illustration for all topics being

addressed.

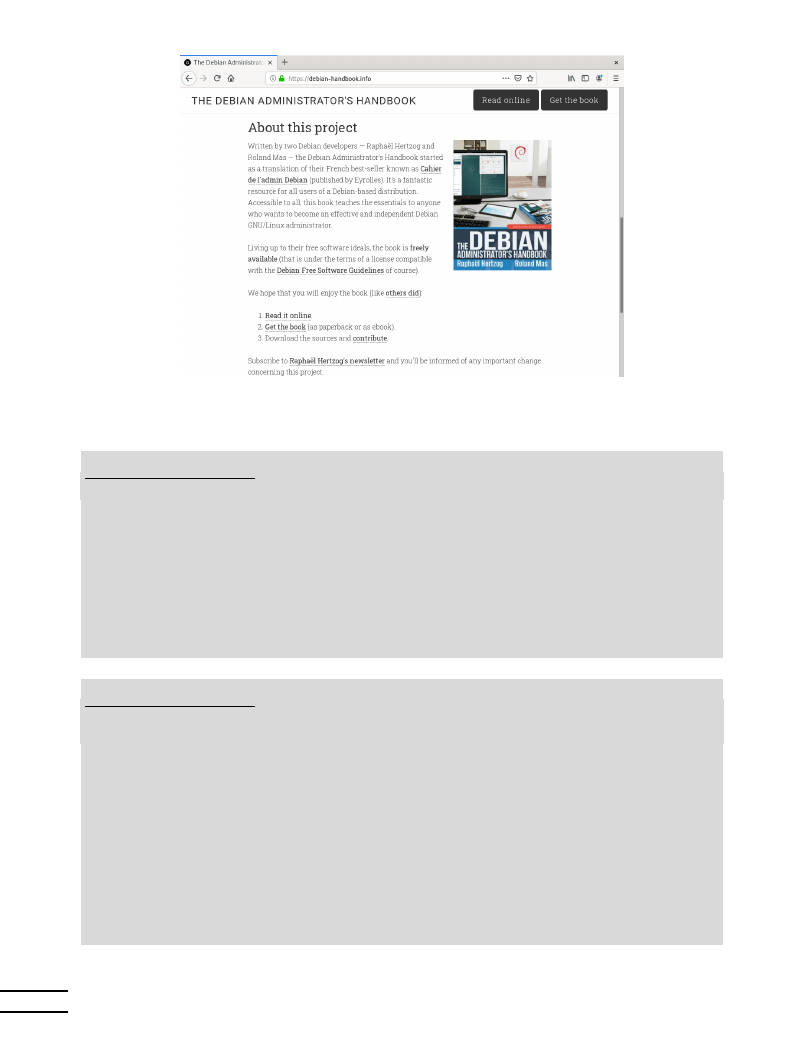

NOTE

Web site, authors’ email

This book has its own website, which hosts whatever elements that can make it

more useful. In particular, it includes an online version of the book with clickable

links, and possible errata. Feel free to browse it and to leave us some feedback. We

will be happy to read your comments or support messages. Send them by email to

hertzog@debian.org (Raphaël) and lolando@debian.org (Roland).

è https://debian-handbook.info/

Chapter 1 focuses on a non-technical presentation of the Debian project and describes its goals

and organization. These aspects are important because they define a general framework that

other chapters will complete with more concrete information.

Chapters 2 and 3 provide a broad outline of the case study. At this point, novice readers can

take the time to read appendix B, where they will find a short remedial course explaining a

number of basic computing notions, as well as concepts inherent to any Unix system.

To get on with our real subject matter, we will quite naturally start with the installation process

(chapter 4); chapters 5 and 6 will unveil basic tools that any Debian administrator will use,

such as those of the APT family, which is largely responsible for the distribution’s excellent

reputation. These chapters are in no way restricted to professionals, since everyone is their

own administrator at home.

Chapter 7 will be an important parenthesis; it describes workflows to efficiently use documen-

tation and to quickly gain an understanding of problems in order to solve them.

The next chapters will be a more detailed tour of the system, starting with basic infrastructure

and services (chapters 8 to 10) and going progressively up the stack to reach the user appli-

cations in chapter 13. Chapter 12 deals with more advanced subjects that will most directly

concern administrators of large sets of computers (including servers), while chapter 14 is a

brief introduction to the wider subject of computer security and gives a few keys to avoid most

problems.

Chapter 15 is for administrators who want to go further and create their own Debian packages.

VOCABULARY

Debian package

A Debian package is an archive containing all the files required to install a piece of

software. It is generally a file with a .deb extension, and it can be handled with the

dpkg

command. Also called a

binary package, it contains files that can be directly

used (such as programs or documentation). On the other hand, a

source package

contains the source code for the software and the instructions required for building

the binary package.

The present version is already the ninth edition of the book (we include the first four that were

only available in French). This edition covers version 10 of Debian, code-named Buster. Among

XXI

Foreword

the changes, Debian now supports UEFI Secure Boot, providing some extra safety against attacks

on the boot infrastructure, and making it easier to install Debian on new computers where Se-

cure Boot is usually enabled by default. Again at the security level, AppArmor, a Mandatory

Access Control system that regulates what various applications are allowed to perform, is now

enabled by default. All included packages have obviously been updated, including the GNOME

desktop, which is now in its version 3.30.

We have added some notes and remarks in sidebars. They have a variety of roles: they can draw

attention to a difficult point, complete a notion of the case study, define some terms, or serve

as reminders. Here is a list of the most common of these sidebars:

• BACK TO BASICS: a reminder of some information that is supposed to be known;

• VOCABULARY: defines a technical term, sometimes Debian specific;

• COMMUNITY: highlights important persons or roles within the project;

• POLICY: a rule or recommendation from the Debian Policy. This document is essential

within the project, and describes how to package software. The parts of the policy high-

lighted in this book bring direct benefits to users (for example, knowing that the policy

standardizes the location of documentation and examples makes it easy to find them even

in a new package).

• TOOL: presents a relevant tool or service;

• IN PRACTICE: theory and practice do not always match; these sidebars contain advice

resulting from our experience. They can also give detailed and concrete examples;

• other more or less frequent sidebars are rather explicit: CULTURE, TIP, CAUTION, GOING

FURTHER, SECURITY, and so on.

Contributing

This book is developed like a free software project, your input and help is welcome. The most

obvious way to contribute is to help translate it into your native language. But that is not the

only possibility. You can open bug reports to let us know of mistakes, typos, outdated informa-

tion, or topics that we should really cover. Or you can submit a merge request with your fix for

whatever issue that you identified.

All the instructions to contribute to the book are documented on the book’s website:

è https://debian-handbook.info/contribute/

Acknowledgments

A Bit of History

In 2003, Nat Makarévitch contacted Raphaël because he wanted to publish a book on Debian in